El proveedor de GPU en la nube permite a las empresas y negocios utilizar la potencia de cálculo bajo demanda (a través de las unidades gráficas en la nube) sin necesidad de invertir en una infraestructura de computación de alto rendimiento.

Las empresas utilizan los proveedores de GPU en nube para llevar a cabo diferentes cargas de trabajo de IA, entre ellas:

- Cargas de trabajo de procesamiento de datos: Para limpiar, manipular y preparar los datos para el aprendizaje de modelos.

- Cargas de trabajo de aprendizaje automático: Para el entrenamiento, desarrollo y despliegue de algoritmos de ML.

- Procesamiento del lenguaje natural (PLN): Paraalgoritmos que enseñan a las máquinas a comprender, generar e interpretar el lenguaje humano.

- Cargas de trabajo de aprendizaje profundo: Para el entrenamiento y despliegue de redes neuronales.

- IA Generativa: Para el entrenamiento de modelos de IA Generativa como los Grandes Modelos de Lenguaje (LLM), que pueden crear nuevos contenidos, incluyendo imágenes, texto y vídeos.

- Visión por ordenador: Para entrenar máquinas que interpreten datos visuales para la toma de decisiones.

Al trasladar las cargas de trabajo de IA a los proveedores de GPU en la nube, las empresas obtienen las siguientes ventajas:

- Mejora de la toma de decisiones respaldada por los datos.

- Mejora de la eficiencia con la automatización de tareas repetitivas

- Capacidad para resolver problemas complejos, mejorar los servicios y desarrollar nuevos productos con algoritmos avanzados de IA.

El equipo de Geekflare ha investigado y elaborado una lista de los mejores proveedores de GPU en la nube basándose en factores como el modelo de GPU, el rendimiento, el precio, la escalabilidad, la integración y la seguridad.

- 1. Google Cloud GPU

- 2. Amazon Web Services (AWS)

- 3. Hyperstack

- 4. Seeweb

- 5. IBM Cloud

- 6. Latitude.sh

- 7. Genesis Cloud

- 8. Paperspace CORE

- 9. OVHcloud

- 10. RunPod

- 11. Lambda GPU

- 12. TensorDock

- 13. Ori

- 14. Nebius

- Show less

1. Google Cloud GPU

Las GPU de Google Cloud ofrecen GPU de alto rendimiento ideales para trabajos de computación como la virtualización 3D, la IA generativa y la computación de alto rendimiento (HPC). Las empresas pueden optar por una amplia selección de GPU, entre las que se incluyen:

- NVIDIA H100

- L4

- P100

- P4

- V100

- T4

- A100

Son personalizables y ofrecen un rendimiento flexible con disco, memoria y procesador de alto rendimiento. Cada instancia admite 8 GPU y sólo tendrá que pagar por lo que utilice con la facturación por segundos.

Además, las empresas que utilizan las GPU de Google Cloud pueden aprovechar la infraestructura de GCP, incluidas sus funciones de red, almacenamiento y análisis de datos.

Precios de Google Cloud GPU

Las GPU de GCP ofrecen los siguientes precios de pago por uso:

- NVIDIA T4: Desde 0,35 $ por GPU (1 GPU y 16 GB GDDR6).

- NVIDIA P4: Desde 0,60 $ por GPU (1 GPU y 8 GB GDDR6).

- NVIDIA V100: Comienza en 2,48 $ por GPU (1 GPU y 16 GB HBM2).

- NVIDIA P100: Desde 1,46 $ por GPU (1 GPU y 16 GB HBM2).

- Estación de trabajo virtual NVIDIA T4: Desde 0,55 $ por GPU (1 GPU y 16 GB GDDR6).

- Estación de trabajo virtual NVIDIA P4: Desde 0,80 $ por GPU (1 GPU y 8 GB GDDR5).

- NVIDIA P100: Desde 1,66 $ por GPU (1 GPU y 16 GB HBM2).

Se obtiene un precio más barato para compromisos más largos (1 año y 3 años).

2. Amazon Web Services (AWS)

AWS ofrece GPU en la nube en colaboración con NVIDIA, lo que proporciona soluciones rentables, flexibles y potentes basadas en GPU.

AWS proporciona las siguientes soluciones:

- NVIDIA AI Enterprises: Una plataforma de software nativa en la nube de extremo a extremo que ofrece modelos preentrenados, acelera las canalizaciones de ciencia de datos y proporciona a los científicos de datos las herramientas para desarrollar e implementar aplicaciones de IA de nivel de producción. También proporciona herramientas para la gestión y la orquestación, garantizando la seguridad, el rendimiento y la fiabilidad.

- Instancias EC2 P5: Las instancias EC2 P5 de alto rendimiento de Amazon también están equipadas con la opción de G4dn (GPU NVIDIA) o G4ad (GPU AMD). Los científicos e ingenieros pueden utilizar estas instancias HPC para ejecutar problemas de cálculo intensivo impulsados por la rápida GPU en la nube, el rendimiento de la red, altas cantidades de memoria y almacenamiento rápido.

- NVIDIA DeepStream y AWS IoT Greengrass: DeepStream permite a los equipos superar las restricciones de tamaño y complejidad de los modelos de ML cuando trabajan con dispositivos IoT. Además, AWS IoT Greengrass puede ampliar los servicios en la nube de AWS a los dispositivos de borde basados en NVIDIA.

- NVIDIA Omniverse: Proporciona a los equipos una plataforma informática para desarrollar flujos de trabajo y aplicaciones basados en 3D con simulación y comprensión del mundo real. También ayuda a mejorar la colaboración y aspectos como la monitorización remota o la creación de prototipos virtuales.

- Estaciones de trabajo virtuales: Las soluciones en la nube de AWS también proporcionan potentes estaciones de trabajo virtuales con tecnología NVIDIA. Los equipos pueden utilizarlas para llevar a cabo tareas complejas de edición de vídeo, modelado 3D y desarrollo de IA.

Precios de AWS

AWS ofrece una capa gratuita en la que puede probar sus servicios de GPU en la nube. Para obtener un presupuesto exacto, póngase en contacto con sus ventas.

3. Hyperstack

Hyperstack es una plataforma vanguardista de GPU como servicio (GPUaaS) que permite a los usuarios implantar cargas de trabajo sin esfuerzo en la nube. Bajo el capó, Hyperstack utiliza el último hardware de NVIDIA. También es más barato en comparación con los proveedores de nubes públicas como AWS y Google Cloud.

Con Hyperstack, sólo paga por lo que consume, lo que la convierte en una opción económica para empresas de todos los tamaños. La plataforma ofrece una velocidad y un rendimiento excelentes a través de sus máquinas virtuales, optimizadas para tareas informáticas de alta intensidad.

Hyperstack abastece a una amplia gama de usuarios, desde entusiastas de la tecnología y pymes hasta grandes empresas y proveedores de servicios gestionados (MSP). Esta escalabilidad es el resultado directo de la sencillez y facilidad de uso de Hyperstack.

La plataforma funciona con energía 100% renovable al tiempo que mantiene un rendimiento de primer nivel. Como parte del programa Inception de NVIDIA, Hyperstack también presta apoyo a algunas de las startups de IA más prometedoras, proporcionándoles aceleración de GPU de nivel empresarial. Disponen de centros de datos en Norteamérica y Europa.

Esto convierte a Hyperstack en una opción ideal para las empresas que buscan aprovechar una infraestructura de GPU potente y escalable al tiempo que contribuyen a un futuro más sostenible.

Precios de Hyperstack

Los precios de Hyperstack dependen del modelo de GPU que elija. Actualmente, ofrece 9 selecciones de GPU, incluido el modelo Nvidia H100 SXM 80 GB, que comienza en 2,25 $/hora.

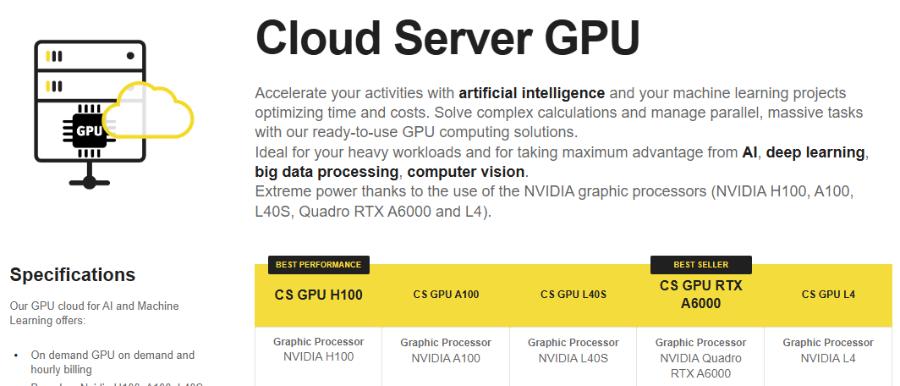

4. Seeweb

Seeweb le ayuda a gestionar proyectos de IA y aprendizaje automático con su arsenal de servicios de GPU en la nube. Con Seeweb, puede trabajar con múltiples casos de uso, incluidos PNL, VDI, big data, procesamiento de vídeo, aplicaciones CUDA, genómica, análisis sísmico y mucho más.

Con sede en Italia, Seeweb dispone de centros de datos en toda la Unión Europea para garantizar la privacidad de los datos conforme a la GDPR y una latencia mínima. También ofrece un rendimiento superior con su hardware dedicado, al tiempo que mantiene los costes económicos con su facturación por horas y bajo demanda.

Presume de una pila tecnológica lista para usar que se basa en potentes tarjetas gráficas, como NVIDIA A100, Quadro RTX A6000, RTX6000, A30 (MIG) y L4.

La compatibilidad de Seeweb con IaC (Terraform) permite gestionar la infraestructura sin problemas, ya que permite definir y controlar los recursos de la GPU a través del código. Asimismo, la plataforma se integra con Kubernetes para agilizar la orquestación de contenedores con el fin de gestionar con eficacia las distintas cargas de trabajo.

Además, Seeweb utiliza recursos energéticos renovables y está comprometida con la sostenibilidad medioambiental con sus certificaciones DNSH e ISO 14001.

En cuanto a la seguridad y la privacidad, la infraestructura en nube de Seeweb cuenta con las certificaciones ISO/IEC 27001, 27017, 27018 y 27701, lo que la hace ideal para alojar datos sensibles de salud, finanzas y otros datos empresariales.

La plataforma ofrece un SLA de garantía de tiempo de actividad del 99,99%, supervisión constante, asistencia técnica 24 horas al día, 7 días a la semana, 365 días al año y protección contra amenazas de Internet como ataques DDoS.

Precios de Seeweb

Seeweb ofrece los siguientes precios:

- Servidor Cloud GPU: Acceso a varias GPU (CS GPU L4, CS GPU L40S, etc.) con precios a partir de 0,38 euros/hora (279 euros/mes).

- GPU sin servidor: Acceso a múltiples GPU (H100, A100, etc.) con precios a partir de 0,42 euros/hora.

- NPU de servidor en nube: Acceso a CS NPU1 y CS NPU 2 con precios a partir de 0,07 euros/hora.

5. IBM Cloud

IBM Cloud ofrece flexibilidad, potencia y opciones de GPU impulsadas por NVIDIA. Proporciona una integración perfecta con la arquitectura, las aplicaciones y las API de IBM Cloud, junto con una red distribuida de centros de datos a nivel mundial.

La plataforma utiliza GPU NVIDIA para llevar a cabo tareas que incluyen IA tradicional, HPC e IA generativa. Con IBM Cloud, puede entrenar, afinar y realizar inferencias utilizando su infraestructura optimizada para el flujo de trabajo de IA. La infraestructura de IA de IBM da acceso a muchas GPU, incluidas las NVIDIA L4, L40S y Tesla V100, con 64 a 320 GB de RAM y un ancho de banda de 16 Gbps a 128 Gbps.

IBM Cloud ofrece una pila de diseño híbrido para el despliegue de Gen AI con acceso a los asistentes de AI, la plataforma de AI, la plataforma de datos, la plataforma de nube híbrida y la infraestructura de GPU.

Precios de IBM Cloud

IBM Cloud ofrece una práctica herramienta para calcular los precios. El precio más barato de su GVP V100 es de 3,024 $/hora, con el que obtendrá acceso a 8 vCPU, 64 GB de RAM y 16 Gbps de ancho de banda.

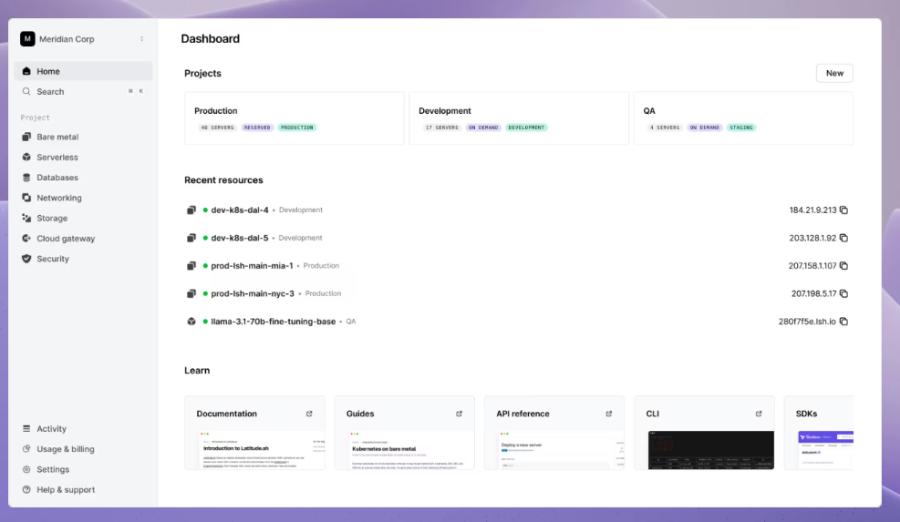

6. Latitude.sh

Latitude.sh está diseñado específicamente para sobrealimentar las cargas de trabajo de IA y aprendizaje automático. Impulsada por las GPU H100 de NVIDIA, la infraestructura de Latitude.sh ofrece un entrenamiento de modelos hasta dos veces más rápido en comparación con GPU de la competencia como la A100.

Optar por Latitude.sh significa que puede desplegar servidores dedicados de alto rendimiento en 18 ubicaciones globales (como Sídney, Fráncfort, Tokio y otras), garantizando una latencia mínima y un rendimiento óptimo.

Cada instancia está optimizada para cargas de trabajo de IA y viene preinstalada con herramientas de aprendizaje profundo como TensorFlow, PyTorch y Jupyter.

El enfoque API-first de Latitude.sh simplifica la automatización, facilitando la integración con herramientas como Terraform. El intuitivo panel de control de Latitude.sh le permite crear vistas, gestionar proyectos y añadir recursos con sólo unos clics.

Precios de Latitude.sh

El precio de las GPU en nube de Latitude.sh comienza en 3 $/hora, y obtendrá acceso a 1 x NVIDIA H100 de 80 GB, 2 x NVME de 3,7 TB y 2 x red de 10 Gbps.

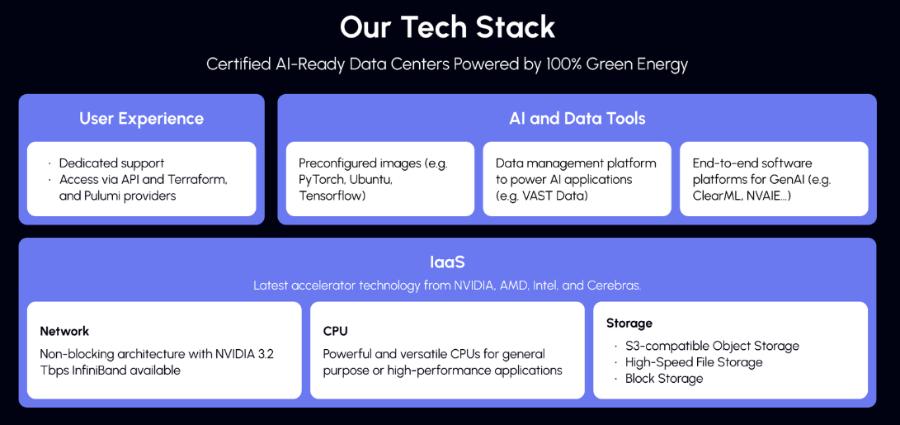

7. Genesis Cloud

Genesis Cloud es un proveedor de nube de IA de primera clase que es asequible, altamente fiable y seguro. Su nube de GPU acelerada también es barata, con precios tan bajos como el 80% en comparación con las nubes heredadas.

Su Genesis Enterprise AI Cloud ofrece a las empresas una plataforma integral de aprendizaje automático y gestión avanzada de datos. También tienen acceso a muchos centros de datos eficientes en todo el mundo, con los que colaboran para ofrecer una amplia gama de aplicaciones.

Genesis Cloud ofrece amplias opciones de GPU, como la HGX H100 y las próximas GPU de arquitectura Blackwell de NVIDIA, incluidas las B200, GB200 y GB200 NVL72.

Además, para garantizar una eficiencia óptima, proporcionan:

- Soluciones de almacenamiento optimizadas para la IA sin tarifas de entrada o salida.

- Redes rápidas, escalables y elásticas para la IA con soporte multinodo.

- Centros de datos de nivel 3 con una garantía de tiempo de actividad del 99,9%.

- Mayor privacidad y seguridad con la certificación ISO270001.

- energía 100% verde y bajo PUE para proteger el medio ambiente y ahorrar costes empresariales.

Precios de Genesis Cloud

El precio de Génesis Cloud es el siguiente.

| Plan | Precio por hora | Ofertas |

|---|---|---|

| Carga de trabajo de inferencia | Comienza en 0,20 $/h | Opción de elegir entre varias GPU. |

| NVIDIA HGX H100/H200 | Comienza en 2,00 $/h | Ideal para contratos a largo plazo con configuraciones personalizadas. |

8. Paperspace CORE

Paperspace CORE ofrece una infraestructura informática acelerada de última generación con una red rápida, compatibilidad con aplicaciones 3D y acceso instantáneo provisional y completo a la API. También es fácil de usar con una interferencia directa para la incorporación.

Con Paperspace CORE, puede construir y ejecutar modelos AI/ML utilizando GPUs NVIDIA H100 en DigitalOcean (DigitalOcean adquirió Paperspace Core en 2023).

Entre las principales características de Paperspace CORE se incluyen las siguientes:

- Ofrece un IDE de portátil de configuración cero con función de colaboración.

- Ahorra hasta un 70% en costes de computación en comparación con las principales nubes públicas.

- Proporciona abstracción de la infraestructura con programación de trabajos, aprovisionamiento de recursos y mucho más.

- Ofrece información para mejorar el proceso global, incluidos los permisos, la utilización del equipo y mucho más.

- Potente consola de gestión que le permite realizar tareas rápidamente, como añadir VPN y gestionar las configuraciones de red.

Precios de Paperspace CORE

Paperspace CORE ofrece planes Plataforma y Compute. Los planes de Plataforma se enumeran a continuación.

| Plan | Precio mensual | Ofertas |

|---|---|---|

| Gratis | $0 | Ideal para principiantes que deseen utilizar proyectos públicos e instancias básicas. |

| Pro | $8 | Ideal para ingenieros e investigadores de ML/AI con proyectos privados e instancias de gama media. |

| Crecimiento | $39 | Ideal para equipos, grupos de investigación y startups que requieran un almacenamiento elevado e instancias de gama alta. |

También ofrecen computación bajo demanda, con precios que oscilan entre 0,76 $/hora (A4000) y 2,24 $/hora (H100).

9. OVHcloud

OVHcloud proporciona servidores en nube diseñados para procesar cargas de trabajo paralelas masivas. Disponen de numerosas instancias integradas con procesadores gráficos NVIDIA Tesla V100 para satisfacer las necesidades de aprendizaje profundo y aprendizaje automático.

Ayudan a acelerar la computación gráfica y la inteligencia artificial. OVHcloud se asocia con NVIDIA para ofrecer la mejor plataforma acelerada por GPU para computación de alto rendimiento, IA y aprendizaje profundo.

La plataforma proporciona un catálogo completo para facilitar la implantación y gestión de contenedores acelerados por GPU. Los desarrolladores pueden utilizar una de las cuatro tarjetas en las instancias directamente a través de PCI Passthrough sin ninguna capa de virtualización para dedicar toda la potencia a su uso.

En cuanto a las certificaciones, los servicios e infraestructuras de OVHcloud cuentan con las certificaciones ISO/IEC 27017, 27001, 27701 y 27018. Estas certificaciones indican que OVHcloud dispone de un sistema de gestión de la seguridad de la información (SGSI) para gestionar las vulnerabilidades, aplicar la continuidad de la actividad, gestionar los riesgos e implantar un sistema de gestión de la información sobre privacidad (SGIP).

Las empresas con un alto rendimiento informático pueden utilizar la GPU en nube de OVHcloud para:

- Reconocimiento de imágenes, clasificando datos a partir de imágenes.

- Análisis de situaciones en tiempo real, como los coches autoconducidos y el análisis del tráfico de la red de Internet.

- Interacciones sobre cómo las máquinas se comunican con las personas a través del sonido y el vídeo.

- Entrenamiento y optimización de modelos de IA con recursos de computación GPU.

Precios de OVHcloud

No hay planes de precios establecidos para OVHcloud. Para obtener un presupuesto a medida, tendrá que ponerse en contacto con su equipo de ventas con sus requisitos.

10. RunPod

RunPod es una nube todo en uno que permite a los ingenieros desarrollar, entrenar y escalar fácilmente modelos de IA. Ofrece una nube de GPU distribuida globalmente en 30 regiones, proporcionándole la infraestructura necesaria para entrenar, construir y desplegar modelos ML.

Con RunPod, puede crear pods de GPU en cuestión de segundos y empezar a desplegarlos. Sus 50 plantillas, como PyTorch, Docker y otras, le ofrecen máquinas listas para usar. También admite contenedores personalizados, todo ello a través de una CLI fácil de usar.

Las características clave de RunPod incluyen:

- Cero tasas por salida/entrada.

- 99.garantía de tiempo de actividad del 99%.

- Interoperabilidad global.

- Almacenamiento en red barato con una capacidad de 10 PB.

- Admite el escalado de inferencia ML sin servidor.

- Obtenga análisis de uso en tiempo real para todos los puntos finales.

- Depure fácilmente los puntos finales con análisis del tiempo de ejecución y registros en tiempo real.

- Proporciona autoescalado en 8 regiones.

- Preparado para la empresa con una infraestructura segura y una conformidad de primera clase.

Precios de RunPod

RunPod ofrece un modelo de pago por uso. Para utilizar las GPU en la nube de RunPod, debe añadir crédito o automatizar los pagos mediante una tarjeta de crédito. Además, ofrece un límite de gasto. Debe registrar una cuenta e introducir sus requisitos para conocer el coste exacto.

11. Lambda GPU

Lambda GPU Cloud ofrece GPUs NVIDIA para entrenar modelos de aprendizaje profundo, ML e IA y escalar fácilmente desde una máquina hasta el número total de VMs.

Ofrece una Lambda Stack completa con todo el software de IA necesario. Entre ellos se incluyen marcos preinstalados como Ubuntu, PyTorch y NVIDIA CUDA, y la última versión de Lambda Stack, que incluye controladores CUDA y marcos de aprendizaje profundo. Además, viene con acceso a Jupyter con un solo clic desde el navegador.

Las principales características de Lambda GPU incluyen:

- NVIDIA H100 bajo demanda.

- Viene con clusters de 1-click con Quantum-2 InfiniBand y GPUs NVIDIA H100 Tensor Core.

- Utilice SSH directamente con una de las claves SSH o conéctese a través del Terminal Web en el panel de control de la nube para obtener acceso directo.

- Admite un máximo de 10 Gbps de ancho de banda entre nodos, ideal para marcos de trabajo que admiten la formación dispersa, como Horovod.

- Ahorro de hasta un 50% en computación con un reducido TCO de la nube.

Precios de Lambda GPU

Lambda GPU ofrece GPU bajo demanda y GPU reservadas. Sus precios de GPU Cloud bajo demanda oscilan entre 0,50 $/GPU/hora (NVIDIA Quadro RTX 6000) y 2,99 $/GPU/hora (8x NVIDIA H100 SXM). Para las GPU reservadas, es necesario ponerse en contacto con sus ventas.

12. TensorDock

TensorDock es una opción ideal para las empresas que buscan servidores de GPU asequibles. Ofrece recursos de GPU bajo demanda a precios bajos y la opción de crear el servidor en 30 segundos.

Las empresas también pueden elegir entre su amplia selección de 45 modelos de GPU disponibles, que incluye la económica RTX 4090 y GPU de cálculo de alto rendimiento más premium, como la HGX H100.

Además, TensorDock admite virtualización KVM con acceso root completo. También es compatible con Windows 10, multithreading y velocidad optimizada de despliegue de máquinas virtuales de extremo a extremo.

Las características clave de TensorDock incluyen:

- Acceso a plantillas de máquinas virtuales como Docker para facilitar la implantación.

- Hasta 30.000 GPU disponibles en 100 ubicaciones.

- API bien documentada.

- Excelente fiabilidad con estándares de tiempo de actividad del 99,99%.

- VM preconfiguradas al instante, desplegables en segundos.

Precios de TensorDock

TensorDock ofrece GPUs Cloud para aprendizaje profundo, renderizado y uso de consumo. Sus precios oscilan entre 0,08 $/hora (GTX 1070) y 2,42 $/hora (H100 SXM5).

13. Ori

Ori es un proveedor de nube de GPU nativa de IA que ofrece servicios rentables, personalizables y fáciles de usar. Ofrece una gama de servicios, incluyendo bare metal y Kubernetes sin servidor.

Ori proporciona acceso a las arquitecturas de GPU NVIDIA más populares, incluidas las NVIDIA B100, B200 y GB200. La plataforma también ha afirmado que en un futuro próximo incorporará a sus filas la arquitectura Blackwell de NVIDIA.

Entre las principales características de Ori Cloud se incluyen:

- Servidores GPU optimizados a medida, ideales para una amplia gama de aplicaciones de IA/ML.

- Una amplia gama de recursos de GPU disponibles para su despliegue.

- Ofrece acceso a varios sabores de computación, incluyendo Kubernetes sin servidor a bare metal.

Precios de Ori

Los precios de la nube de GPU Ori oscilan entre 0,95 $/hora (NVIDIA V100s) y 3,80 $/hora (NVIDIA H100 SXM). Sólo ofrece planes bajo demanda.

14. Nebius

Nebious le permite crear, ajustar y ejecutar modelos de IA utilizando la infraestructura de GPU NVIDIA mejor gestionada, incluidos los últimos clusters de GPU H100/H200.

Ofrece una plataforma de IA de pila completa que incluye lo siguiente:

- Plataforma de IA y Marketplace: Enumera soluciones MLOps populares, como Kuberflow, Airflow, Ray y otras. También incluye PostgreSQL gestionado, MLflow gestionado y Spark gestionado.

- Nube de IA: Ofrece acceso a clústeres escalables con soluciones de almacenamiento, redes y orquestación, incluidos clústeres de GPU, K8s gestionados, Compute, Storage y otros.

- Hardware y centro de datos: Acceso a un centro de datos energéticamente eficiente, red InfiniBand de 3,2 Tbit/s y GPU NVIDIA (H100, H200, L40s).

Además, le permite gestionar la infraestructura como código mediante CLI, API y Terraform. Nebius también proporciona acceso a soporte experto las 24 horas del día, los 7 días de la semana.

Precios de Nebius

Los precios de Nebius oscilan entre 1,18 $/h (L40 de reserva de 12 meses) y 3,5 $/h (H200 de reserva de 6 meses).

¿Cuáles son las ventajas de la GPU en la nube?

Existen 5 beneficios principales de utilizar GPU en nube, como se muestra a continuación.

- Mejora de las tareas intensivas en datos: Las GPU en la nube ofrecen a las empresas (especialmente a las de sectores de procesamiento de datos críticos en tiempo real como la sanidad) la posibilidad de abordar tareas intensivas en datos con un rendimiento mejorado. Por ejemplo, las GPU en la nube pueden manejar complejos análisis de big data, aprendizaje automático e IA. Esto conduce a una toma de decisiones más rápida y mejor y a una ventaja competitiva sobre los competidores.

- Eficiencia de costes: La GPU en nube elimina la necesidad de construir, gestionar y mantener la infraestructura de la GPU, lo que garantiza la eficiencia de costes para las empresas en crecimiento. La mayoría de los proveedores de GPU en nube ofrecen precios de pago por uso, lo que reduce aún más los costes. Además, las empresas no tienen que preocuparse por las actualizaciones ni por el aumento de los costes energéticos.

- Mayor rapidez de comercialización: Con el uso de las GPU en la nube, las empresas pueden sacar sus productos/servicios al mercado con mayor rapidez.

- Escalabilidad mejorada: Las empresas en crecimiento pueden beneficiarse de las opciones de escalabilidad, ya que la mayoría de las GPU en nube proporcionan escalabilidad horizontal y vertical con la opción de reducir la escala cuando sea necesario.

- Colaboración y accesibilidad mejoradas: El GPU Computing en la nube reúne a los equipos para trabajar en problemas sin restricciones de geolocalización.