Vous souhaitez créer vos propres applications d’IA générative ? Voici une liste de modèles d’IA pour vous aider à démarrer.

Lesmodèles d’IA sont des architectures de réseaux neuronaux extrêmement performantes pour des tâches spécifiques. Il s’agit notamment d’architectures de réseaux neuronaux convolutifs pour la classification et la segmentation d’images, de grands modèles de langage génératifs pré-entraînés, de modèles de diffusion pour les tâches de génération d’images, et d’autres architectures de réseaux neuronaux génératifs

Récemment, les modèles d’IA pour les applications d’IA générative (image, parole, texte, etc.) sont devenus très populaires. Cela est dû à la fois aux progrès de la recherche et à l’accès à l’informatique de haute performance.

Voici un bref résumé des modèles d’IA les plus populaires dont je vais parler ci-dessous.

| Modèle | Principales capacités |

|---|---|

| GPT-4 | Un grand modèle de langage open-source peut être utilisé pour construire des applications alimentées par LLM |

| LLaMA | Variété d’applications NLP, des chatbots aux assistants de codage |

| Falcon | Un grand modèle de langage open-source peut être utilisé pour construire des applications alimentées par LLM |

| Diffusion stable | Conversion de texte en image, inpainting, outpainting et upscaling d’images |

| DALL-E 2 | Génération texte-image |

| Chuchotement | Reconnaissance vocale, traduction linguistique et détection de la langue |

| StableLM | Modèle de langue large et léger à source ouverte |

| CLIP | Diverses tâches NLP, telles que la réponse à des questions, le résumé et la génération de textes |

| InternLM | Un grand modèle de langage open-source ; peut être utilisé pour construire des applications alimentées par LLM |

| Modèle Segment Anything | Généralisation à zéro coup pour une variété de tâches de segmentation d’images |

| WaveGAN | Génération d’audio |

| CycleGAN | Traduction d’image à image |

| BioGPT | Génération et exploration de textes biomédicaux |

De l’art de l’IA à la création d’un assistant de codage personnalisé, vous pouvez créer toute une série d’applications d’IA générative en fonction de vos centres d’intérêt. Nous présentons ici une liste de modèles d’IA intéressants que vous pouvez explorer, ainsi que leurs principales capacités.

C’est parti !

GPT-4

Qu’il s’agisse de générer l’itinéraire de votre prochain voyage ou de rédiger des lettres de motivation correspondant à la description d’un poste, ChatGPT fait désormais partie de nos tâches quotidiennes. GPT-4, son successeur, est un modèle de langage large encore plus puissant.

Il s’agit du système d’IA le plus puissant de l’OpenAI, avec des capacités de raisonnement et des performances supérieures à celles de ChatGPT.

Voici une présentation technique sur le fonctionnement de GPT-4 et sur la manière dont vous pouvez créer des applications avec lui.

Vous pouvez accéder à l’interface ChatGPT avec un compte OpenAI gratuit. Pour accéder à GPT-4, cependant, vous devez avoir un abonnement ChatGPT Plus.

Voici quelques applications que vous pouvez créer avec ces grands modèles de langage :

- Chatbots personnalisés

- Amélioration des plateformes CRM

- Réponse à des questions sur un corpus personnalisé

- Autres tâches telles que le résumé et la génération de texte

Ensuite, nous allons passer en revue quelques modèles de langage de grande taille open-source.

LLaMA

Meta AI a publié LLaMA, un grand modèle de langage fondamental avec 65B paramètres, en février 2023. Par la suite, LLama 2 a été publié avec des améliorations substantielles par rapport à la version précédente. Vous pouvez accéder aux éléments suivants :

- Llama Chat : Llama 2 peaufiné

- Code Llama : construit sur Llama 2 ; entraîné sur plus de 500 milliards de tokens de code ; prend en charge la génération de code dans tous les langages de programmation les plus populaires

Vous pouvez télécharger et utiliser les modèles Llama en demandant un accès. Consultez ce tutoriel pour apprendre à utiliser LLama 2 dans vos applications Python :

Falcon

Falcon est un autre modèle de langage open-source créé par le Technology Innovation Institute (UAE). Tous les modèles de la suite Falcon LLM sont open source et disponibles en libre accès. Vous pouvez donc les utiliser pour créer des applications alimentées par LLM.

Il existe actuellement quatre tailles de modèles : 1.3B, 7.5B, 40B et 180B. Afin d’obtenir de meilleures performances que sur plusieurs benchmarks, le modèle 180B a été entraîné sur un ensemble de données de 3.5T tokens. Le LLM Falcon a des performances comparables à celles d’autres LLM open-source de premier plan.

Le LLM open-source Falcon 180B atteint des performances proches de celles de GPT-4. Consultez ce tutoriel qui couvre Falcon 180B, comment vous pouvez l’utiliser, les exigences matérielles, et comment le comparer à GPT-4 :

Diffusion stable

Stable Diff usion est un modèle texte-image pour la génération d’images et d’autres applications créatives d’IA. Il peut également être utilisé pour la mise à l’échelle et l’incrustation d’images.

Stable DiffusionXL, sorti en juillet 2023, offre plusieurs améliorations, notamment

- la génération d’images descriptives à partir d’invites beaucoup plus courtes

- la possibilité de générer du texte d’accompagnement dans les images

- les tâches d’inpainting et d’outpainting d’images

- l’interaction avec une image source pour générer des variantes

Si vous souhaitez apprendre comment fonctionnent les modèles de diffusion – la méthode qui se cache derrière la magie – consultez How Diffusion Models Work, un cours gratuit de DeepLearning.AI.

DALL-E 2

DALL-E 2 d’Open AI est un autre modèle populaire de génération de texte à partir d’images. Vous pouvez l’utiliser pour générer des images réalistes et des œuvres d’art à partir d’une description en langage naturel.

Il peut être utilisé pour les tâches suivantes

- génération d’images à partir d’invites textuelles

- l’inpainting et l’outpainting d’images

- générer des variations d’une image

Vous pouvez accéder à DALL-E 2 via l’API OpenAI ou l’interface web des laboratoires OpenAI.

Whisper

Whisper d’Open AI est un modèle de reconnaissance vocale qui peut être utilisé pour une multitude d’applications, notamment

- l’identification de la langue

- les tâches dereconnaissance vocale telles que la transcription de fichiers audio

- la traduction de la parole

Voici un tutoriel sur la façon de convertir la parole en texte à l’aide de l’API Whisper d’OpenAI :

Pour tester le modèle, vous pouvez installer whisper(openai-whisper) à l’aide de pip et accéder à l’API à partir d’un script Python pour transcrire des fichiers audio. En outre, vous pouvez utiliser d’autres grands modèles de langage pour résumer la transcription et construire un pipeline fichier audio → résumé.

StableLM

StableLM est une suite LLM open-source de Stability AI. Les paramètres 3B et 7B sont actuellement disponibles. Les versions ultérieures incluront des modèles plus larges avec 15B – 65B paramètres.

Donc, si vous voulez expérimenter des LLM légers et open-source dans vos applications, vous pouvez essayer StableLM.

CLIP

CLIP est l’acronyme de Contrastive Language-Image Pre-training. Il s’agit d’un réseau neuronal, un modèle multimodal, entraîné sur un grand ensemble de données de paires (texte, image). Le modèle exploite les données en langage naturel et tente d’apprendre, à partir des descriptions en langage naturel, la sémantique des images. Le modèle CLIP est capable de prédire le texte le plus pertinent à partir d’une image.

Avec CLIP, vous pouvez effectuer une classification d’images à partir de zéro, sans préapprentissage ni mise au point coûteux. De plus, vous pouvez exploiter les capacités de CLIP et des bases de données vectorielles pour créer des applications intéressantes dans les domaines suivants :

- recherche texte-image et image-image

- la recherche d’images inversées

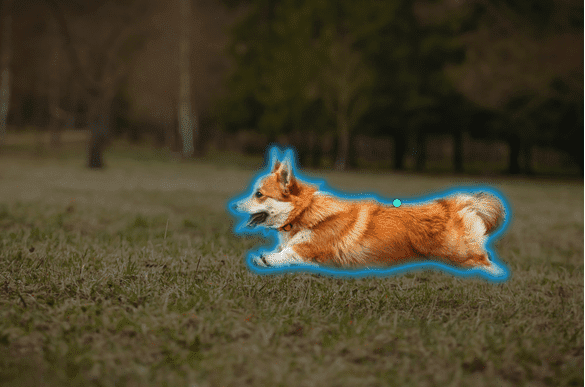

Modèle Segment Anything

La segmentation d’images est la tâche qui consiste à identifier les pixels appartenant à un objet spécifique dans une image. Meta AI a publié Segment Anything Model (SAM ) qui peut être utilisé pour segmenter n’importe quelle image et en découper des objets.

Vous pouvez utiliser des invites pour spécifier ce qu’ il faut segmenter dans une image. SAM prend actuellement en charge les invites suivantes : boîtes de délimitation, masques et points d’avant-plan et d’arrière-plan. Le modèle présente également d’excellentes performances de généralisation sur des images inédites. Aucune formation explicite n’est donc nécessaire.

Essayez le modèle SAM dans votre navigateur!

InternLM

InternLM est un modèle de langue open-source. Vous pouvez essayer le modèle de base 7B et le modèle de chat open-source. Le modèle prend en charge une fenêtre contextuelle de 8K. En outre, InternLM prend en charge l’interprète de code et les capacités d’appel de fonction.

InternLM est également disponible dans la bibliothèque de transformateurs HuggingFace. Vous pouvez exploiter le cadre léger de pré-entraînement. Il prend également en charge la création et le déploiement d’applications à l’aide de LMDeploy. Vous pouvez donc créer des applications NLP génératives de bout en bout avec InternLM.

WaveGAN

WaveGAN est un modèle de génération audio. Il permet de synthétiser de l’audio brut à partir d’échantillons de données audio réelles.

Vous pouvez entraîner WaveGAN sur un ensemble de données de fichiers audio arbitraires et synthétiser de l’audio sans traitement préalable important.

CycleGAN

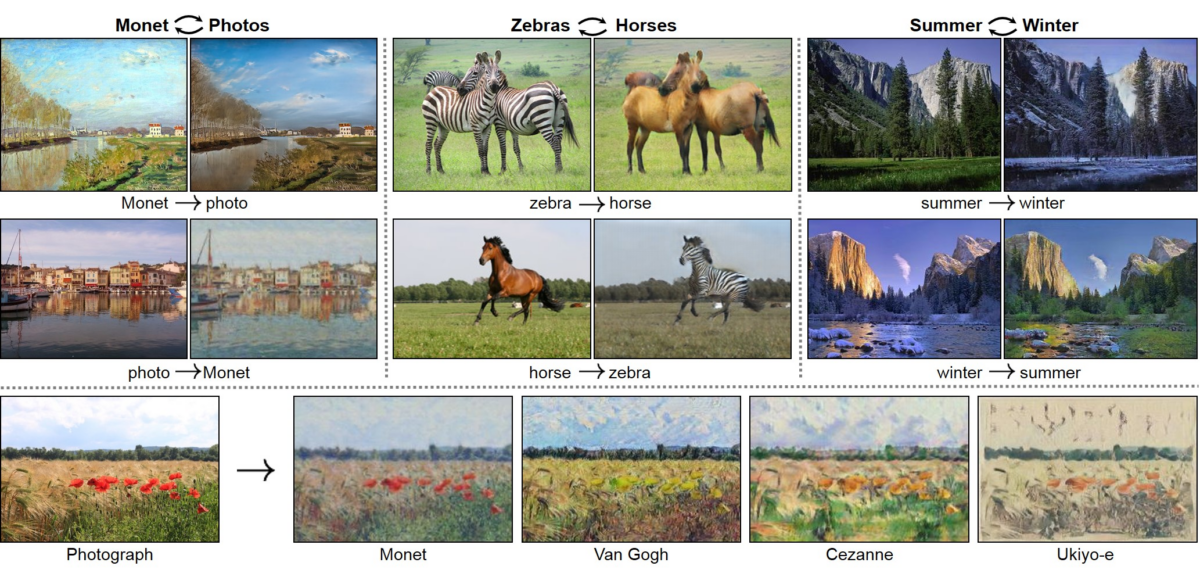

Jusqu’à présent, nous avons abordé les modèles de traduction de la parole vers le texte, du texte vers l’image et d’autres modèles pour diverses tâches de traitement du langage naturel. Mais qu’en est-il si vous souhaitez effectuer une traduction d’image à image ? Dans ce cas, vous pouvez utiliser CycleGAN pour apprendre une correspondance entre le domaine source et le domaine cible afin de réaliser une traduction d’image à image.

Par exemple, étant donné l’image d’un lac en hiver, vous pouvez vouloir traduire la même image lorsque la saison est l’été. Dans l’image d’un cheval, vous pouvez remplacer le cheval par un zèbre tout en conservant le même arrière-plan. CycleGAN est bien adapté à de telles tâches.

Vous pouvez trouver les implémentations PyTorch de CycleGAN sur GitHub.

BioGPT

BioGPT de Microsoft est un modèle de transformateur que vous pouvez utiliser pour l’exploration de données biomédicales et les applications de génération de texte. Il utilise les implémentations du modèle séquence à séquence fournies par fairseq.

Fairseq de Facebook research (maintenant Meta AI) est une boîte à outils qui fournit des implémentations de modèles séquence-à-séquence pour des tâches telles que :

- la modélisation du langage

- la traduction

- le résumé

Les modèles pré-entraînés et les points de contrôle des modèles affinés sont disponibles. Vous pouvez télécharger le modèle soit à partir de l’URL, soit à partir du hub HuggingFace.

Les modèles BioGPT font également partie de la bibliothèque de transformateurs HuggingFace. Ainsi, si vous travaillez dans le domaine biomédical, vous pouvez utiliser BioGPT pour construire des applications spécifiques à un domaine.

Conclusion

J’espère que vous avez trouvé quelques modèles utiles avec lesquels vous pouvez créer des applications d’IA générative. Bien que cette liste ne soit pas exhaustive, nous avons couvert certains des modèles les plus populaires que vous pouvez utiliser pour créer des applications de génération de texte et d’audio, de transcription de la parole au texte, de recherche d’images, etc.

Lorsque vous créez des applications à l’aide de grands modèles de langage, vous devez être conscient des pièges courants, tels que les informations factuellement incorrectes et les hallucinations. Vous risquez également d’être confronté à des limitations lors de l’affinage des modèles, car le processus d’affinage est souvent gourmand en ressources.

Si vous êtes développeur, il est donc temps de rejoindre la révolution de l’IA et de commencer à créer des applications d’IA intéressantes ! Vous pouvez essayer ces modèles dans Google Colab ou d’autres carnets de notes collaboratifs sur la science des données.