Sora AI est un modèle de conversion de texte en vidéo développé par OpenAI, l’entreprise à l’origine de ChatGPT. Sora AI est encore en cours de développement, il faudra donc attendre pour savoir comment accéder à Sora – pour l’instant. Malgré cela, il est important d’examiner ses performances par rapport à d’autres générateurs de texte-vidéo afin d’appréhender l’avenir de la création de contenu par l’IA.

Les exemples de vidéos d’OpenAI démontrent la capacité de Sora AI à produire des images photoréalistes. De plus, Sora AI ne semble pas avoir de difficultés à créer des animations de type dessin animé visuellement agréables. Les mouvements des personnages, l’éclairage, les proportions et les détails les plus infimes (tels que les imperfections du visage et la texture de la fourrure) sont assez précis. Sora AI est donc en passe de devenir le modèle d’IA texte-vidéo idéal.

Les meilleurs générateurs d’IA texte-vidéo disponibles à l’heure actuelle sont faciles à utiliser et créent des contenus de haute qualité, même s’ils présentent des limites notables. Jusqu’à présent, même les générateurs les plus utilisés ne peuvent produire avec précision que des visages, des torses et des voix humaines. OpenAI semble innover en proposant des fonctionnalités uniques qui se démarquent de la concurrence.

Le développement de nouveaux modèles d’IA, plus complexes et de plus en plus impressionnants, est devenu une véritable course aux armements. Si les programmeurs d’IA travaillent d’arrache-pied pour inventer des outils nouveaux et utiles, il est également nécessaire de mettre en place des protocoles de sécurité.

Il est essentiel d’empêcher que des modèles puissants comme Sora ne soient utilisés pour créer des animations inappropriées (haineuses, violant les droits d’auteur et autres possibilités négatives). Non seulement pour notre sécurité, mais aussi pour mettre en œuvre les meilleures pratiques rationnelles dans l’industrie, ce que l’OpenAI prend au sérieux.

Comment accéder à Sora AI

Il n’y a actuellement aucun accès public à Sora AI. Seules quelques personnes peuvent utiliser ce modèle de conversion de texte en vidéo. Outre les “red teamers” qui cherchent à rendre l’utilisation aussi sûre que possible, l’OpenAI a donné accès à quelques artistes, designers et cinéastes à des fins de test.

Dans un récent article de la FAQ d’OpenAI sur l’accès à Sora, la société a déclaré qu’elle n’avait pas de calendrier pour la mise à disposition du public. De plus, OpenAI ne donne pas de détails sur les personnes impliquées en dehors de ses bureaux. Elle a vaguement mentionné un engagement avec des décideurs politiques, des éducateurs et d’autres personnes pour obtenir un retour d’information sur le développement et l’utilisation responsables de Sora.

Pouvez-vous devenir un testeur de Sora AI ?

Jusqu’à présent, il n’existe aucun moyen officiel de devenir un testeur de Sora – ouun membre de l’équipe rouge d’OpenAI De nombreux fils de discussion ont été consacrés à ces questions sur le forum communautaire d’OpenAI. Cependant, les modérateurs rappellent rapidement aux utilisateurs qu’il n’y a pas de moyen officiel de s’inscrire pour tester Sora. À la suite de ces rappels, les fils de discussion sont fermés pour éviter d’embrouiller les autres utilisateurs.

OpenAI est déterminée à rendre Sora aussi sûr que possible avant de laisser le grand public mettre la main sur ce modèle d’IA complexe. La raison principale du manque de détails est également la sécurité. Donner des informations sur les testeurs n’est pas sûr, car ils pourraient être pris pour cible.

Il faudra donc attendre un certain temps avant que le public ait accès à Sora. OpenAI met en avant la qualité de son modèle d’IA en cours de développement, de sorte qu’une diffusion générale n’est peut-être pas trop éloignée dans le temps. La plupart des entreprises ont tendance à commercialiser leurs services et leurs produits bien avant leur lancement, mais généralement pas des années à l’avance. Par conséquent, il est raisonnable de penser que le lancement public de Sora AI aura lieu vers 2024 ou 2025.

Exemples de fonctionnement de Sora AI

Sora peut se targuer d’une animation de pointe dans de nombreux domaines (éclairage, détails minutieux, etc.), mais elle se heurte aux écueils habituels de l’IA.

Ce que l’IA de Sora ne peut pas encore faire

L’interprétation des concepts et des instructions pose quelques problèmes. Par exemple, lorsqu’on lui demande de créer des images d’un “bernard l’hermite utilisant une ampoule incandescente comme carapace”, Sora produit des images d’une créature ressemblant à un crabe avec une carapace générique sur le dos qui possède une ampoule sur son arrière-train.

Dans cette animation de longue durée, il est clair que le personnage ne ressemble que vaguement à un crabe. Oui, il a des pattes et des pinces, mais aucune espèce vivante de crabe (ou d’animaux ressemblant à des crabes) n’a une carapace comme celle représentée dans l’imagerie de Sora. De plus, l’ampoule n’est pas utilisée comme une carapace, elle est simplement attachée à l’arrière du cadre du personnage.

Vous trouverez un autre exemple sur la page web de l’OpenAI consacrée à Sora. L’une des cinq vidéos décrivant les faiblesses actuelles de Sora montre un homme courant sur un tapis roulant à l’envers. Des critères tels que les directions – haut, bas, gauche et droite – sont actuellement difficiles à analyser pour Sora. OpenAI a fait preuve de transparence et d’honnêteté quant aux lacunes de son modèle texte-vidéo en cours de développement, ce qui semble indiquer qu’elle sait où et comment s’améliorer.

Globalement, il y a 5 problèmes majeurs (connus) avec les graphiques de Sora AI :

- Interprétation directionnelle

- Les personnages et les objets apparaissent et disparaissent

- Les objets et les personnages se déplacent les uns à travers les autres

- Définir quand les objets sont censés être rigides ou souples

- Détermination des résultats des interactions physiques entre les personnages et les objets

N’oubliez pas que Sora AI a encore un long chemin à parcourir avant d’être prêt pour le grand public. C’est pourquoi ses faiblesses actuelles seront certainement abordées et corrigées, du moins dans une certaine mesure.

Ce que Sora AI fait de bien

Bien que le prochain générateur de texte-vidéo d’OpenAI ne puisse pas gérer tous les aspects des interactions intimes entre les personnages et les objets, les visuels sont presque parfaits lorsque l’accent est mis sur l’environnement.

Lesplans d’ensemble de la caméra décrivant les paysages côtiers et les vues aériennes enneigées de Tokyo sont d’un réalisme saisissant. De même, les scènes de vie sauvage sont convaincantes.

De plus, Sora est capable de combiner des éléments organiques et inorganiques lorsque les instructions sont vagues. Contrairement à des instructions complexes et uniques telles que “Donnez une ampoule à un bernard-l’ermite en guise de carapace”, des instructions plus simples et plus libres telles que “Berger allemand cybernétique” donnent des résultats plus attrayants.

N’oubliez pas que les modèles d’IA doivent apprendre en ingérant des données. Il existe beaucoup plus d’exemples visuels de chiens équipés de prothèses que d’images de bernard-l’hermite portant des objets en verre sur le dos.

Dans le même ordre d’idées, Sora AI a accès à une multitude d’images de la nature pour produire des animations de type documentaire presque impossibles à distinguer de la réalité. La génération d’images telles qu’un papillon posé sur une fleur est cohérente et élégante.

Pour des raisons inverses, Sora peut créer des contenus d’une esthétique impressionnante dans des contextes totalement fictifs. Lorsqu’il y a moins de physique du monde réel à prendre en compte, les modèles d’IA texte-vidéo comblent souvent logiquement les lacunes dans les informations fournies. Par conséquent, les simulations représentant des concepts de science-fiction tels que la course de drones sur la planète Mars sont superbes, même si elles ne sont pas réalistes (en raison de la nature de l’invite).

L’élaboration d’un message-guide pour une animation plus proche du dessin animé bénéficie de cette liberté. Si la formulation de l’invite est bien ajustée, Sora peut transformer un paragraphe de texte en une animation comparable à celle de Pixar et d’autres grands studios d’animation. Le résultat peut être les adorables ébats d’un écureuil sphérique, outoute autre chose souhaitée par l’utilisateur.

Le monde étrange des générateurs de texte à vidéo

Outre les utilisateurs qui se tournent vers les générateurs de vidéo par IA pour des raisons de conception et de réalisation de films, certains souhaitent accéder à Sora pour s’amuser. En repoussant les limites des détails de l’invite, les utilisateurs peuvent obtenir des contenus hilarants et bizarres. Des courses de vélo surréalistes à travers les océans à la fusion avec une couverture sur un lit, certains résultats sont appréciés davantage pour leur valeur comique que pour leurs objectifs artistiques.

D’une part, les aspects fantastiques sont attrayants pour les créatifs en quête de divertissement. D’un autre côté, ces images faciliteront certainement le développement des films. Par exemple, si un réalisateur souhaite tourner une scène dans une réalité alternative où les animaux mangent des bijoux, le moins que l’on puisse dire, c’est qu’il y aura des tonnes de problèmes liés aux droits des animaux. Toutefois, grâce à Sora AI, de telles scènes peuvent être générées sur un ordinateur sans le moindre risque.

De nos jours, l’industrie cinématographique est bien meilleure que par le passé pour ce qui est de traiter les non-humains avec compassion sur le plateau de tournage. Si ce n’était pas le cas, ce podcast sur le Golden Retriever aurait certainement quelque chose à dire à ce sujet ! Plus sérieusement, les générateurs de texte-vidéo vont révolutionner la manière dont les films sont réalisés.

Un regard sur les processus techniques de Sora AI

Pour comprendre comment Sora peut créer des panoramas époustouflants et réaliser des tours de magie avec une cuillère, consultez le rapport technique d’OpenAI.

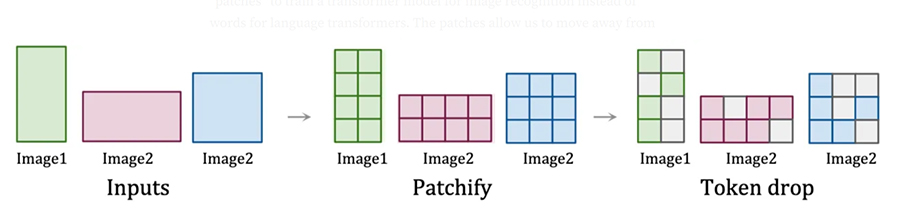

Le processus commence par la compression des données d’image en parcelles d’espace-temps qui agissent comme des jetons de transformation. En termes simples, les parcelles d’espace-temps (dans ce cas) sont de petites sections d’informations visuelles comportant des marqueurs temporels. Les jetons de transformation constituent le plus petit niveau d’unités de données utilisées dans la formation à l’IA : chaque parcelle est un jeton.

Décomposer davantage le processus :

- Les entrées d’images sont identifiées

- Les entrées d’images sont disséquées en parcelles

- Des parcelles aléatoires (jetons) sont analysées jusqu’à ce qu’elles aient toutes été traitées

Le processus de découpage et de transformation des données visuelles en jetons permet aux modèles d’IA d’apprendre efficacement. Sora peut ainsi déterminer comment les éléments sont liés, quand les actions sont censées se produire, et bien d’autres choses encore. En outre, Sora peut consommer des données visuelles provenant de résolutions et de rapports d’aspect multiples. Plus précisément, l’ingestion d’images et de vidéos dans leur format natif permet aux modèles d’IA d’apprendre à évaluer plus précisément les différents aspects visuels en comparant les différences entre chaque jeton.

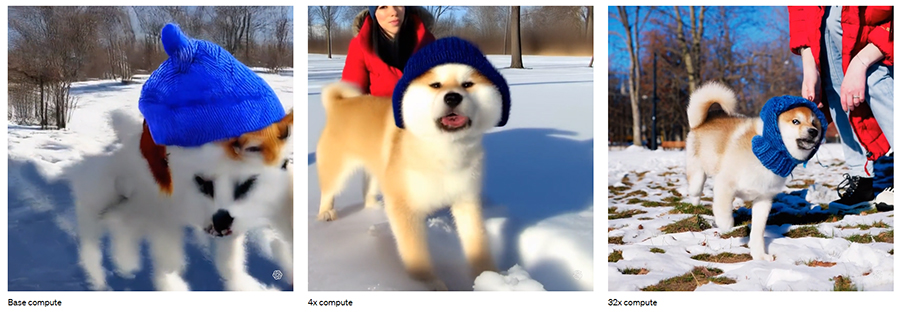

Cela dit, le processus ne s’arrête pas là ! Une fois les jetons ingurgités, des calculs complexes sont effectués plusieurs fois par séquence de génération de contenu. Au début (calcul de base), la vidéo créée semble abstraite. Cependant, au fur et à mesure que le calcul d’entraînement augmente, Sora devient de plus en plus capable de produire des visuels analogues à la vie réelle.

Avis de l’auteur

Ce que l’on a pu voir de Sora jusqu’à présent fait exploser la concurrence. Les générateurs de texte-vidéo existants ne sont viables que pour insérer un hôte humain dans le contenu. Rien de ce qui existe actuellement sur le marché ne permet de créer des vidéos complexes, étonnantes et (pour la plupart) réalistes à partir de simples invites textuelles.

Pour faire la part des choses : Sora AI a encore un long chemin à parcourir avant que le public ne soit autorisé à y accéder. Cela dit, elle est incroyablement prometteuse pour de nombreux usages artistiques et scientifiques. Non seulement elle peut être un outil fantastique pour la réalisation de films, mais elle pourrait un jour permettre aux scientifiques de simuler des scénarios jusqu’alors impossibles. Certes, le concept de physique de Sora doit encore être amélioré avant qu’il puisse être utilisé pour cette dernière raison, mais il est probable que Sora et d’autres modèles d’IA comme lui y parviendront d’ici quelques années.

Imaginez, par exemple, un monde où les esprits les plus brillants peuvent utiliser des générateurs texte-vidéo pour simuler les conséquences de divers accidents. Les chercheurs pourraient ainsi créer des combinaisons de sécurité d’une qualité inégalée pour une fraction de leur budget précédent. Cela permettrait de réduire le nombre de blessures, les frais médicaux et les coûts des opérations hospitalières, ce qui serait bénéfique pour la société.

Mais on en est encore loin. Tandis que les leaders de l’industrie s’efforcent d’approfondir la compréhension de Sora et d’autres modèles similaires, il existe de nombreuses vidéos d’IA farfelues à regarder. En attendant, asseyez-vous, détendez-vous et préparez l’avenir.