Le fournisseur de GPU en nuage permet aux sociétés et aux entreprises d’utiliser la puissance de calcul à la demande (via les unités graphiques en nuage) sans investir dans une infrastructure de calcul à haute performance.

Les entreprises utilisent les fournisseurs de GPU en nuage pour exécuter différentes charges de travail d’IA, notamment :

- Les charges de travail de traitement des données : Pour le nettoyage, la manipulation et la préparation des données pour l’apprentissage de modèles.

- Charges de travail liées à l’apprentissage automatique : Pour la formation, le développement et le déploiement des algorithmes de ML.

- Traitement du langage naturel (NLP) : Pour lesalgorithmes qui apprennent aux machines à comprendre, générer et interpréter le langage humain.

- Charges de travail d’apprentissage profond : Pour la formation et le déploiement de réseaux neuronaux.

- IA générative : pour la formation de modèles d’IA génériques tels que les grands modèles de langage (LLM), qui peuvent créer de nouveaux contenus, notamment des images, du texte et des vidéos.

- Vision par ordinateur : Pour former des machines à interpréter des données visuelles en vue de prendre des décisions.

En confiant les charges de travail d’IA à des fournisseurs de GPU en nuage, les entreprises bénéficient des avantages suivants :

- Amélioration de la prise de décision grâce aux données.

- Amélioration de l’efficacité grâce à l’automatisation des tâches répétitives

- Capacité à résoudre des problèmes complexes, à améliorer les services et à développer de nouveaux produits grâce à des algorithmes d’IA avancés.

L’équipe de Geekflare a étudié et répertorié les meilleurs fournisseurs de GPU en nuage en se basant sur des facteurs tels que le modèle de GPU, la performance, la tarification, l’évolutivité, l’intégration et la sécurité.

- 1. Google Cloud GPUs

- 2. Amazon Web Services (AWS)

- 3. Hyperstack

- 4. Seeweb

- 5. IBM Cloud

- 6. Latitude.sh

- 7. Genesis Cloud

- 8. Paperspace CORE

- 9. OVHcloud

- 10. RunPod

- 11. Lambda GPU

- 12. TensorDock

- 13. Ori

- 14. Nebius

- Show less

1. Google Cloud GPUs

Les GPU Google Cloud offrent des GPU hautes performances idéaux pour les tâches informatiques telles que la virtualisation 3D, l’IA générative et le calcul haute performance (HPC). Les entreprises peuvent choisir parmi une large sélection de GPU, notamment :

- NVIDIA H100

- L4

- P100

- P4

- V100

- T4

- A100

Elles sont personnalisables et offrent des performances flexibles grâce à des disques, des mémoires et des processeurs très performants. Chaque instance prend en charge 8 GPU et vous ne payez que ce que vous utilisez grâce à la facturation à la seconde.

En outre, les entreprises qui utilisent les GPU de Google Cloud peuvent tirer parti de l’infrastructure GCP, notamment de ses capacités de mise en réseau, de stockage et d’analyse des données.

Prix des GPU Google Cloud

Les GPU GCP proposent une tarification à l’usage comme suit :

- NVIDIA T4: À partir de 0,35 $ par GPU (1 GPU et 16 Go GDDR6).

- NVIDIAP4: à partir de 0,60 $ par GPU (1 GPU et 8 Go GDDR6).

- NVIDIA V100: à partir de 2,48 $ par GPU (1 GPU et 16 Go HBM2).

- NVIDIAP100: à partir de 1,46 $ par GPU (1 GPU et 16 Go HBM2).

- Station de travail virtuelle NVIDIA T4: À partir de 0,55 $ par GPU (1 GPU et 16 Go GDDR6).

- Station de travail virtuelle NVIDIA P4: À partir de 0,80 $ par GPU (1 GPU et 8 Go GDDR5).

- NVIDIA P100: à partir de 1,66 $ par GPU (1 GPU et 16 Go HBM2).

Vous bénéficiez d’un prix plus avantageux pour les engagements plus longs (1 an et 3 ans).

2. Amazon Web Services (AWS)

AWS propose des GPU dans le nuage en collaboration avec NVIDIA, offrant des solutions économiques, flexibles et puissantes basées sur le GPU.

AWS propose les solutions suivantes :

- NVIDIA AI Enterprises : Une plateforme logicielle cloud-native de bout en bout qui propose des modèles pré-entraînés, accélère les pipelines de science des données et donne aux data scientists les outils pour développer et déployer des apps d’IA de niveau production. Elle fournit également des outils de gestion et d’orchestration, garantissant la sécurité, la performance et la fiabilité.

- Instances EC2 P5 : Les instances EC2 P5 hautes performances d’Amazon sont également équipées au choix de G4dn (GPU NVIDIA) ou de G4ad (GPU AMD). Les scientifiques et les ingénieurs peuvent utiliser ces instances HPC pour exécuter des problèmes de calcul intensif grâce à la rapidité du GPU cloud, aux performances du réseau, à la quantité élevée de mémoire et à la rapidité du stockage.

- NVIDIA DeepStream et AWS IoT Greengrass : DeepStream permet aux équipes de surmonter les restrictions de taille et de complexité des modèles ML lorsqu’elles travaillent avec des appareils IoT. De plus, AWS IoT Greengrass peut étendre les services cloud AWS aux appareils périphériques basés sur NVIDIA.

- NVIDIA Omniverse : Fournit aux équipes une plate-forme informatique pour développer des flux de travail et des applications en 3D avec une simulation et une compréhension du monde réel. Il permet également d’améliorer la collaboration et les aspects tels que la surveillance à distance ou le prototypage virtuel.

- Postes de travail virtuels : Les solutions AWS Cloud fournissent également de puissantes stations de travail virtuelles optimisées par NVIDIA. Les équipes peuvent les utiliser pour réaliser des montages vidéo complexes, des modélisations 3D et des développements d’IA.

Prix AWS

AWS propose un niveau gratuit qui vous permet d’essayer ses services de GPU dans le nuage. Pour un devis précis, contactez le service commercial.

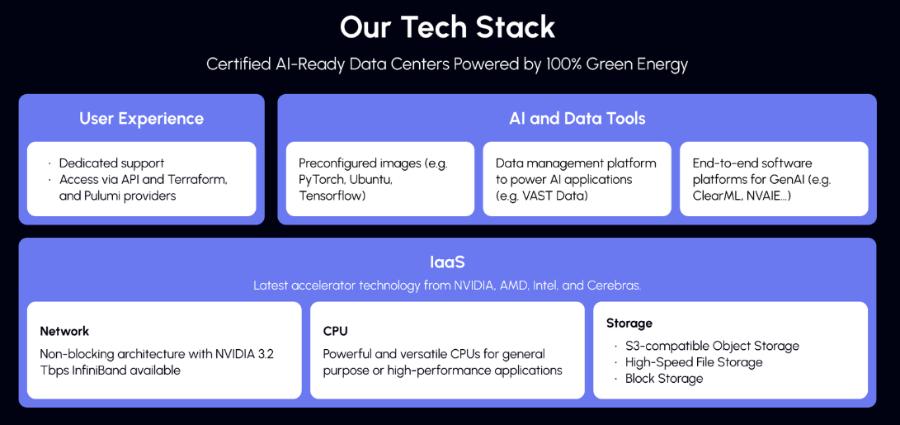

3. Hyperstack

Hyperstack est une plateforme GPU-as-a-Service (GPUaaS) de pointe qui permet aux utilisateurs de déployer des charges de travail sans effort dans le nuage. Sous le capot, Hyperstack utilise le matériel NVIDIA le plus récent. Il est également moins cher que les fournisseurs de clouds publics tels qu’AWS et Google Cloud.

Avec Hyperstack, vous ne payez que ce que vous consommez, ce qui en fait un choix économique pour les entreprises de toutes tailles. La plateforme offre une vitesse et des performances excellentes grâce à ses machines virtuelles, qui sont optimisées pour les tâches informatiques à haute intensité.

Hyperstack s’adresse à un large éventail d’utilisateurs, des passionnés de technologie et des PME aux grandes entreprises et aux fournisseurs de services gérés (MSP). Cette évolutivité est le résultat direct de la simplicité et de la facilité d’utilisation d’Hyperstack.

La plate-forme fonctionne avec 100 % d’énergie renouvelable tout en conservant des performances de premier plan. Dans le cadre du programme Inception de NVIDIA, Hyperstack soutient également certaines des startups les plus prometteuses en matière d’IA, en leur fournissant une accélération GPU de niveau professionnel. L’entreprise dispose de centres de données en Amérique du Nord et en Europe.

Hyperstack est donc un choix idéal pour les entreprises qui cherchent à tirer parti d’une infrastructure GPU puissante et évolutive tout en contribuant à un avenir plus durable.

Prix d’Hyperstack

Les prix d’Hyperstack dépendent du modèle de GPU que vous avez choisi. Actuellement, il propose 9 sélections de GPU, dont le modèle Nvidia H100 SXM 80 Go, qui démarre à 2,25 $/heure.

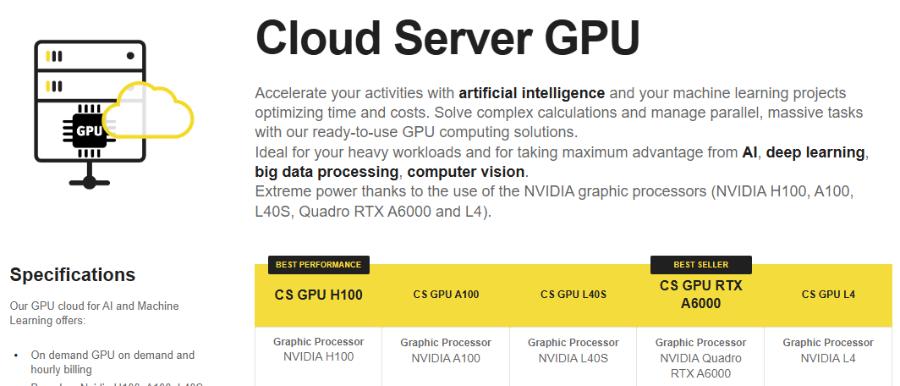

4. Seeweb

Seeweb vous aide à gérer les projets d’IA et d’apprentissage automatique grâce à son arsenal de services GPU en nuage. Avec Seeweb, vous pouvez travailler sur de multiples cas d’utilisation, notamment le NLP, la VDI, le big data, le traitement vidéo, les applications CUDA, la génomique, l’analyse sismique, etc.

Basé en Italie, Seeweb dispose de centres de données dans toute l’Union européenne pour garantir la confidentialité des données conformément à la GDPR et une latence minimale. Elle offre également des performances supérieures grâce à son matériel dédié, tout en maintenant des coûts économiques grâce à sa facturation horaire et à la demande.

Elle s’enorgueillit d’une pile technologique prête à l’emploi basée sur de puissantes cartes graphiques, notamment NVIDIA A100, Quadro RTX A6000, RTX6000, A30 (MIG) et L4.

La prise en charge de l’IaC (Terraform) de Seeweb permet une gestion transparente de l’infrastructure en vous permettant de définir et de contrôler vos ressources GPU par le biais du code. De même, la plateforme s’intègre à Kubernetes pour une orchestration rationalisée des conteneurs afin de gérer efficacement les différentes charges de travail.

De plus, Seeweb utilise des ressources énergétiques renouvelables et s’engage à respecter l’environnement grâce à ses certifications DNSH et ISO 14001.

En matière de sécurité et de confidentialité, l’infrastructure cloud de Seeweb est certifiée ISO/IEC 27001, 27017, 27018 et 27701, ce qui la rend idéale pour l’hébergement de données sensibles dans les domaines de la santé, de la finance et d’autres secteurs d’activité.

La plateforme offre une garantie de disponibilité de 99,99 %, une surveillance constante, une assistance technique 24 heures sur 24, 7 jours sur 7 et 365 jours par an, ainsi qu’une protection contre les menaces Internet telles que les attaques DDoS.

Tarifs Seeweb

Seeweb propose les tarifs suivants :

- Cloud Server GPU : Accès à plusieurs GPU (CS GPU L4, CS GPU L40S, etc.) à partir de 0,38 €/heure (279 €/mois).

- GPU sans serveur : Accès à plusieurs GPU (H100, A100, etc.) à partir de 0,42 €/heure.

- Serveur cloud NPU : Accès à CS NPU1 et CS NPU 2 à partir de 0,07 €/heure.

5. IBM Cloud

IBM Cloud offre de la flexibilité, de la puissance et des options GPU optimisées par NVIDIA. Il offre une intégration transparente avec l’architecture, les applications et les API d’IBM Cloud, ainsi qu’un réseau distribué de centres de données dans le monde entier.

La plateforme utilise les GPU NVIDIA pour effectuer des tâches, y compris l’IA traditionnelle, le HPC et l’IA générative. Avec IBM Cloud, vous pouvez vous entraîner, affiner et effectuer des inférences en utilisant son infrastructure optimisée pour le flux de travail de l’IA. L’infrastructure d’IA d’IBM vous donne accès à de nombreux GPU, dont les NVIDIA L4, L40S et Tesla V100, avec 64 à 320 Go de RAM et une bande passante allant de 16 Gbps à 128 Gbps.

IBM Cloud offre une pile de conception hybride pour le déploiement de Gen AI avec un accès aux assistants AI, à la plateforme AI, à la plateforme de données, à la plateforme de cloud hybride et à l’infrastructure GPU.

Prix d’IBM Cloud

IBM Cloud propose un outil pratique pour calculer les prix. Le prix le plus bas de son GVP V100 est de 3,024 $/heure, ce qui vous donne accès à 8 vCPU, 64 Go de RAM et 16 Gbps de bande passante.

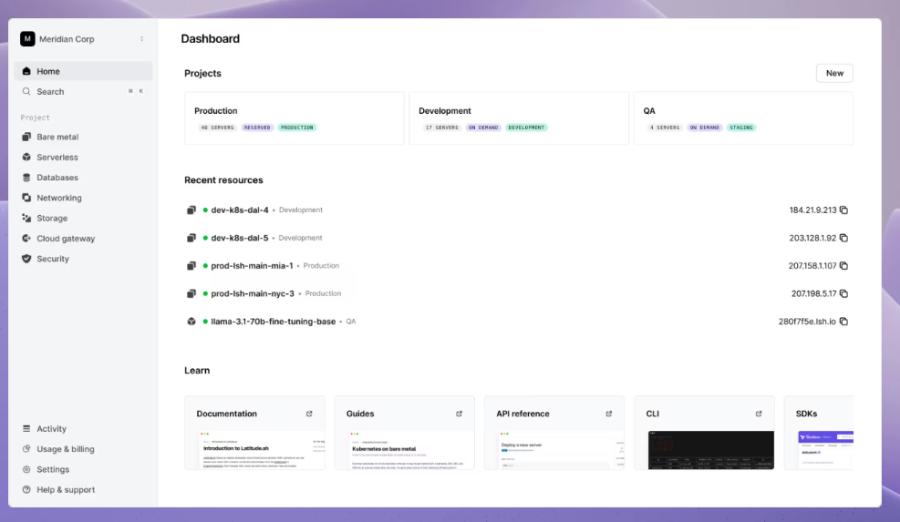

6. Latitude.sh

Latitude.sh est spécialement conçu pour optimiser les charges de travail liées à l’IA et à l’apprentissage automatique. Alimentée par les GPU H100 de NVIDIA, l’infrastructure de Latitude.sh offre un apprentissage de modèle jusqu’à deux fois plus rapide que les GPU concurrents tels que le A100.

En optant pour Latitude.sh, vous pouvez déployer des serveurs dédiés de haute performance sur 18 sites mondiaux (tels que Sydney, Francfort, Tokyo et autres), ce qui garantit une latence minimale et des performances optimales.

Chaque instance est optimisée pour les charges de travail d’IA et est préinstallée avec des outils d’apprentissage profond tels que TensorFlow, PyTorch et Jupyter.

L’approche API-first de Latitude.sh simplifie l’automatisation, ce qui facilite l’intégration avec des outils tels que Terraform. Le tableau de bord intuitif de Latitude.sh vous permet de créer des vues, de gérer des projets et d’ajouter des ressources en quelques clics.

Prix de Latitude.sh

Le prix des GPU en nuage de Latitude.sh commence à 3 $/heure, et vous avez accès à 1 x NVIDIA H100 80 Go, 2 x 3,7 TB NVME, et 2 x 10 Gbps réseau.

7. Genesis Cloud

Genesis Cloud est un fournisseur de cloud d’IA de premier ordre, abordable, très fiable et sécurisé. Son cloud GPU accéléré est également bon marché, avec des prix aussi bas que 80 % par rapport aux clouds traditionnels.

Leur Genesis Enterprise AI Cloud offre aux entreprises une plateforme d’apprentissage automatique de bout en bout et une gestion avancée des données. Ils ont également accès à de nombreux centres de données performants dans le monde entier, avec lesquels ils collaborent pour proposer une large gamme d’applications.

Genesis Cloud propose des options GPU étendues, telles que le HGX H100 et les prochains GPU de l’architecture Blackwell de NVIDIA, notamment B200, GB200 et GB200 NVL72.

En outre, pour garantir une efficacité optimale, ils fournissent :

- Des solutions de stockage optimisées pour l’IA sans frais d’entrée ou de sortie.

- Des réseaux rapides, évolutifs et élastiques pour l’IA avec prise en charge de plusieurs nœuds.

- Des centres de données de niveau 3 avec une garantie de disponibilité de 99,9 %.

- Meilleures confidentialité et sécurité avec la certification ISO270001.

- une énergie 100 % verte et un faible PUE pour protéger l’environnement et réduire les coûts de l’entreprise.

Prix de Genesis Cloud

Le prix de Genesis Cloud est le suivant.

| Plan | Prix horaire | Offres |

|---|---|---|

| Charge de travail d’inférence | À partir de 0,20 $/h | Possibilité de choisir parmi une variété de GPU. |

| NVIDIA HGX H100/H200 | À partir de 2,00 $/h | Idéal pour les contrats à long terme avec des configurations personnalisées. |

8. Paperspace CORE

Paperspace CORE offre une infrastructure de calcul accéléré de nouvelle génération avec un réseau rapide, la prise en charge d’applications 3D et un accès provisoire et complet à l’API. Il est également facile à utiliser avec des interférences directes pour l’intégration.

Avec Paperspace CORE, vous pouvez construire et exécuter des modèles d’IA/ML utilisant des GPU NVIDIA H100 sur DigitalOcean (DigitalOcean a acquis Paperspace Core en 2023).

Les principales caractéristiques de Paperspace CORE sont les suivantes :

- Offre un IDE pour ordinateur portable à configuration zéro avec une fonction de collaboration.

- Économisez jusqu’à 70 % des coûts de calcul par rapport aux principaux nuages publics.

- Fournit une abstraction de l’infrastructure avec la planification des tâches, le provisionnement des ressources et plus encore.

- Offre des informations permettant d’améliorer le processus global, notamment les autorisations, l’utilisation des équipes, etc.

- Console de gestion puissante qui vous permet d’effectuer des tâches rapidement, telles que l’ajout de VPN et la gestion des configurations réseau.

Tarifs Paperspace CORE

Paperspace CORE propose des plans de plate-forme et de calcul. Les plans Plateforme sont listés ci-dessous.

| Plan | Prix mensuel | Offres |

|---|---|---|

| Gratuit | $0 | Idéal pour les débutants qui souhaitent utiliser des projets publics et des instances de base. |

| Pour | $8 | Idéal pour les ingénieurs et chercheurs en ML/AI avec des projets privés et des instances de milieu de gamme. |

| Croissance | $39 | Idéal pour les équipes, les groupes de recherche et les startups qui ont besoin d’un stockage important et d’instances haut de gamme. |

Ils proposent également des services de calcul à la demande, avec des prix allant de 0,76 $/heure (A4000) à 2,24 $/heure (H100).

9. OVHcloud

OVHcloud fournit des serveurs cloud conçus pour traiter des charges de travail parallèles massives. Les GPU ont de nombreuses instances intégrées avec des processeurs graphiques NVIDIA Tesla V100 pour répondre aux besoins d’apprentissage profond et d’apprentissage automatique.

Ils permettent d’accélérer le calcul graphique et l’intelligence artificielle. OVHcloud s’associe à NVIDIA pour proposer la meilleure plateforme accélérée par le GPU pour le calcul haute performance, l’IA et l’apprentissage profond.

La plateforme fournit un catalogue complet pour faciliter le déploiement et la gestion des conteneurs accélérés par le GPU. Les développeurs peuvent utiliser l’une des quatre cartes vers les instances directement via PCI Passthrough sans aucune couche de virtualisation pour dédier toutes les puissances à votre usage.

Côté certifications, les services et infrastructures d’OVHcloud sont certifiés ISO/IEC 27017, 27001, 27701 et 27018. Ces certifications indiquent qu’OVHcloud dispose d’un système de gestion de la sécurité de l’information (ISMS) pour gérer les vulnérabilités, mettre en œuvre la continuité des activités, gérer les risques et mettre en œuvre un système de gestion des informations relatives à la vie privée (PIMS).

Les entreprises ayant des performances de calcul élevées peuvent utiliser le GPU Cloud d’OVHcloud pour :

- La reconnaissance d’images, la classification de données à partir d’images.

- L’analyse de situations en temps réel, comme les voitures auto-conduites et l’analyse du trafic sur les réseaux internet.

- Interactions sur la façon dont les machines communiquent avec les personnes par le biais du son et de la vidéo.

- Entraînez et optimisez les modèles d’IA à l’aide de ressources informatiques GPU.

Tarifs OVHcloud

Il n’existe pas de plan tarifaire fixe pour OVHcloud. Pour obtenir un devis personnalisé, vous devez contacter l’équipe commerciale et lui faire part de vos besoins.

10. RunPod

RunPod est un nuage tout-en-un qui permet aux ingénieurs de développer, d’entraîner et de mettre à l’échelle des modèles d’intelligence artificielle. Il offre un nuage de GPU distribué à l’échelle mondiale dans 30 régions, vous donnant l’infrastructure nécessaire pour former, construire et déployer des modèles de ML.

Avec RunPod, vous pouvez créer des pods GPU en quelques secondes et commencer à les déployer. Ses 50 modèles, tels que PyTorch, Docker et autres, vous permettent d’obtenir des machines prêtes à l’emploi. Il prend également en charge les conteneurs personnalisés, le tout par le biais d’un CLI facile à utiliser.

Les principales fonctionnalités de RunPod sont les suivantes :

- Aucun frais pour la sortie et l’entrée.

- 99.garantie de temps de fonctionnement de 99 %.

- Interopérabilité mondiale.

- Stockage réseau bon marché avec une capacité de 10 Po.

- Prise en charge de la mise à l’échelle de l’inférence ML sans serveur.

- Obtenez des analyses d’utilisation en temps réel pour tous les points d’extrémité.

- Débogage facile des points d’extrémité avec des analyses de temps d’exécution et des journaux en temps réel.

- Fournit une mise à l’échelle automatique dans 8 régions.

- Prêt pour l’entreprise avec une infrastructure sécurisée et une conformité de classe mondiale.

Prix RunPod

RunPod propose un modèle de paiement à l’utilisation. Pour utiliser les GPU en nuage de RunPod, vous devez ajouter un crédit ou automatiser les paiements à l’aide d’une carte de crédit. De plus, il y a une limite de dépenses. Vous devez créer un compte et entrer vos besoins pour connaître le coût exact.

11. Lambda GPU

Lambda GPU Cloud propose des GPU NVIDIA pour entraîner des modèles d’apprentissage profond, de ML et d’IA et passer facilement d’une machine au nombre total de VM.

Elle offre une pile Lambda complète avec tous les logiciels d’IA nécessaires. Il s’agit notamment de cadres préinstallés tels qu’Ubuntu, PyTorch et NVIDIA CUDA, ainsi que de la dernière version de la pile Lambda, qui comprend des pilotes CUDA et des cadres d’apprentissage profond. De plus, il est livré avec un accès Jupyter en un clic depuis le navigateur.

Les principales caractéristiques de Lambda GPU sont les suivantes :

- NVIDIA H100 à la demande.

- Il est livré avec des clusters en 1 clic comprenant Quantum-2 InfiniBand et des GPU NVIDIA H100 Tensor Core.

- Utilisez directement SSH avec l’une des clés SSH ou connectez-vous via le terminal Web dans le tableau de bord du cloud pour un accès direct.

- Prend en charge un maximum de 10 Gbps de bande passante inter-nœuds, ce qui est idéal pour les frameworks qui prennent en charge l’entraînement dispersé, tels que Horovod.

- Économisez jusqu’à 50 % sur l’informatique grâce à un coût total de possession réduit.

Prix du Lambda GPU

Lambda GPU propose des GPU à la demande et des GPU réservés. Le prix de ses GPU Cloud à la demande varie de 0,50 $/GPU/h (NVIDIA Quadro RTX 6000) à 2,99 $/GPU/h (8x NVIDIA H100 SXM). Pour les GPU réservés, vous devez contacter le service des ventes.

12. TensorDock

TensorDock est un choix idéal pour les entreprises à la recherche de serveurs GPU abordables. Il offre des ressources GPU à la demande à bas prix et la possibilité de créer un serveur en 30 secondes.

Les entreprises peuvent également choisir parmi une large sélection de 45 modèles de GPU disponibles, y compris la RTX 4090 économique et des GPU de calcul de haute performance plus haut de gamme tels que les HGX H100.

En outre, TensorDock prend en charge la virtualisation KVM avec un accès racine complet. Il prend également en charge Windows 10, le multithreading et une vitesse de déploiement des VM optimisée de bout en bout.

Les principales caractéristiques de TensorDock sont les suivantes :

- Accès à des modèles de VM tels que Docker pour un déploiement facile.

- Jusqu’à 30 000 GPU sont disponibles sur 100 sites.

- API bien documentée.

- Excellente fiabilité avec des normes de disponibilité de 99,99 %.

- VM préconfigurées instantanément, déployables en quelques secondes.

Prix de TensorDock

TensorDock propose des GPU Cloud pour l’apprentissage profond, le rendu et l’utilisation grand public. Ses tarifs vont de 0,08 $/h (GTX 1070) à 2,42 $/h (H100 SXM5).

13. Ori

Ori est un fournisseur de cloud GPU natif pour l’IA qui propose des services rentables, personnalisables et faciles à utiliser. Il propose une gamme de services, notamment bare metal et serverless Kubernetes.

Ori permet d’accéder aux architectures GPU NVIDIA les plus courantes, notamment NVIDIA B100, B200 et GB200. La plate-forme a également déclaré qu’elle intégrerait prochainement l’architecture NVIDIA Blackwell dans ses rangs.

Les principales caractéristiques d’Ori Cloud sont les suivantes

- Des serveurs GPU optimisés et construits sur mesure, idéaux pour une large gamme d’applications AI/ML.

- Une large gamme de ressources GPU disponibles pour le déploiement.

- Offre un accès à différentes saveurs de calcul, y compris Kubernetes sans serveur à bare metal.

Prix Ori

Les prix du nuage de GPU Ori varient de 0,95 $/h (NVIDIA V100s) à 3,80 $/h (NVIDIA H100 SXM). Ori ne propose que des plans à la demande.

14. Nebius

Nebious vous permet de construire, d’ajuster et d’exécuter des modèles d’IA en utilisant l’infrastructure GPU NVIDIA la mieux gérée, y compris les derniers clusters de GPU H100/H200.

Elle offre une plateforme d’IA complète comprenant les éléments suivants :

- Plate-forme d’IA et place de marché : Répertorie les solutions MLOps les plus populaires, notamment Kuberflow, Airflow, Ray et d’autres. Elle inclut également PostgreSQL, MLflow et Spark gérés.

- AI Cloud : Offre un accès à des clusters évolutifs avec des solutions de stockage, de mise en réseau et d’orchestration, y compris des clusters GPU, des K8 gérés, Compute, Storage, et plus encore.

- Matériel et centre de données : Accès à un centre de données économe en énergie, à un réseau InfiniBand de 3,2 Tbit/s et à des GPU NVIDIA (H100, H200, L40s).

En outre, il vous permet de gérer l’infrastructure en tant que code à l’aide de CLI, API et Terraform. Nebius vous donne également accès à un support expert 24/7.

Prix Nebius

Les prix de Nebius varient de 1,18 $/h (L40s en réserve de 12 mois) à 3,5 $/h (H200 en réserve de 6 mois).

Quels sont les avantages du GPU en nuage ?

L’utilisation des GPU en nuage présente cinq avantages principaux, comme indiqué ci-dessous.

- Amélioration des tâches à forte intensité de données : Les GPU en nuage donnent aux entreprises (en particulier pour les industries de traitement de données critiques en temps réel comme la santé) la possibilité de s’attaquer à des tâches intensives en données avec des performances améliorées. Par exemple, les GPU en nuage peuvent gérer des analyses complexes de big data, l’apprentissage automatique et l’IA. Cela permet une prise de décision plus rapide et de meilleure qualité, ainsi qu’un avantage concurrentiel sur les concurrents.

- Rentabilité : Les GPU en nuage éliminent la nécessité de construire, de gérer et de maintenir l’infrastructure GPU, ce qui garantit la rentabilité des entreprises en croissance. La plupart des fournisseurs de GPU en nuage proposent une tarification à l’usage, ce qui réduit encore les coûts. De plus, les entreprises n’ont pas à se soucier de la mise à niveau ou de l’augmentation des coûts énergétiques.

- Une mise sur le marché plus rapide : Grâce aux GPU en nuage, les entreprises peuvent commercialiser leurs produits/services plus rapidement.

- Une meilleure évolutivité: Les entreprises en croissance peuvent bénéficier d’options d’évolutivité, car la plupart des GPU en nuage offrent une évolutivité horizontale et verticale, avec la possibilité de réduire l’évolutivité en cas de besoin.

- Amélioration de la collaboration et de l’accessibilité : L’informatique GPU en nuage permet aux équipes de travailler ensemble sur des problèmes sans restrictions géographiques.