Votre explication unique sur les Deepfakes et pour les réaliser facilement avec Faceswap.

Les deepfakes consistent à utiliser des techniques basées sur l’intelligence artificielle et l’apprentissage profond pour modifier le contenu audio ou vidéo d’une vidéo en le manipulant. L’intelligence artificielle n’est plus si “artificielle” que cela. De nos jours, elle s’est dangereusement rapprochée de nous, les humains.

Elle peut suggérer, écrire, créer des œuvres d’art et, désormais, elle ressemble et parle comme les vivants.

C’est l’une des évolutions les plus récentes dans ce domaine dont nous devrions tirer parti. Mais il faut aussi s’en méfier.

Qu’est-ce qu’un Deepfake ?

Le terme “Deepfake” a été inventé en combinant les termes “deep learning” et “fake”. En termes simples, vous pouvez également supposer qu’il s’agit d’un média manipulé de manière experte ou profondément truqué.

Selon Wikipédia, il s’agit également d’un média synthétique dans lequel une image, un son ou une vidéo existants sont modifiés pour représenter quelqu’un d’autre.

En général, les deepfakes font apparaître des personnalités renommées comme ayant dit quelque chose qu’elles n’auraient pas dit autrement.

En fonction de l’habileté de son créateur, il peut être extrêmement difficile de déterminer s’il s’agit d’un vrai ou d’un faux.

Comment fonctionnent les deepfakes ?

Pour faire simple, une partie de la vidéo originale (par exemple un visage) est remplacée par un faux d’apparence similaire. Dans ce cas, on parle de “faceswap”, comme dans cette vidéo Deepfake “Obama”.

Cependant, le phénomène ne se limite pas à la vidéo, et nous disposons également de deepfakes d’images et d’audio (et qui sait, de deepfakes d’avatars VR dans un avenir proche).

La méthode de travail derrière ces supercheries dépend principalement de l’application et de l’algorithme sous-jacent.

Selon ce document de recherche de Disney, il existe plusieurs techniques, notamment les encodeurs-décodeurs, les réseaux adverbiaux génératifs (GAN), les deepfakes basés sur la géométrie, etc.

Cependant, les sections suivantes sont principalement affectées par la façon dont cela fonctionne avec Facewap. Il s’agit d’un logiciel de deepfake gratuit et open-source qui permet d’utiliser plusieurs algorithmes pour obtenir le résultat escompté.

Il existe trois processus principaux pour générer des deepfakes : l’extraction, l’entraînement et la conversion.

#1. L’extraction

Il s’agit de détecter et d’extraire le sujet d’intérêt à partir d’échantillons de médias, l’original et celui destiné à l’échange.

En fonction des capacités matérielles, de nombreux algorithmes peuvent être utilisés pour une détection efficace.

Par exemple, Faceswap propose différentes options d’extraction, d’alignement et de masquage en fonction de l’efficacité du processeur ou du processeur graphique.

L’extraction permet simplement d’identifier le visage dans l’ensemble de la vidéo. L’alignement permet de repérer les caractéristiques essentielles d’un visage (yeux, nez, menton, etc.). Enfin, le masquage bloque les autres éléments de l’image à l’exception de la zone d’intérêt.

Le temps global nécessaire à la production est un élément important dans le choix d’une option, car le fait de choisir des algorithmes gourmands en ressources sur un matériel médiocre peut entraîner un échec ou un temps très long pour obtenir des résultats acceptables.

Outre le matériel, le choix dépend également de paramètres tels que la présence ou non d’obstructions faciales sur la vidéo d’entrée, comme des mouvements de main ou des lunettes.

Un élément nécessaire, à la fin, est le nettoyage (expliqué plus loin) de la sortie, car les extractions auront quelques faux positifs.

Enfin, l’extraction est répétée pour la vidéo originale et la fausse (utilisée pour l’échange).

#2. Entraînement

C’est le cœur de la création de deepfakes.

L’entraînement concerne le réseau neuronal, qui se compose de l’encodeur et du décodeur. Ici, les algorithmes sont alimentés par les données extraites afin de créer un modèle pour la conversion ultérieure.

L’encodeur convertit l’entrée en une représentation vectorielle pour entraîner l’algorithme à recréer les visages à partir de vecteurs, comme le fait le décodeur.

Ensuite, le réseau neuronal évalue ses itérations et les compare à l’original en attribuant un score de perte. Cette valeur de perte diminue au fil des itérations de l’algorithme, et vous vous arrêtez lorsque les aperçus sont acceptables.

L’apprentissage est un processus qui prend du temps, et les résultats s’améliorent généralement en fonction des itérations effectuées et de la qualité des données d’entrée.

Par exemple, Faceawap suggère un minimum de 500 images chacune, l’originale et celle à échanger. En outre, les images doivent être très différentes les unes des autres et couvrir tous les angles possibles sous un éclairage unique pour une recréation optimale.

En fonction de la durée de l’entraînement, certaines applications (comme Faceswap) permettent d’interrompre l’entraînement à mi-parcours ou de le reprendre plus tard.

Notamment, le photoréalisme du résultat dépend également de l’efficacité de l’algorithme et des données d’entrée. Et l’on est encore une fois limité par les capacités du matériel.

#3. Conversion

C’est le dernier chapitre de la création d’un deepfake. Les algorithmes de conversion ont besoin de la vidéo source, du modèle entraîné et du fichier d’alignement source.

Ensuite, vous pouvez modifier quelques options relatives à la correction des couleurs, au type de masque, au format de sortie souhaité, etc.

Après avoir configuré ces quelques options, vous n’avez plus qu’à attendre le rendu final.

Comme indiqué, Faceswap fonctionne avec de nombreux algorithmes, et vous pouvez jouer entre eux pour obtenir un faceswap acceptable.

Est-ce tout ?

Non !

Il ne s’agissait que d’un échange de visages, un sous-ensemble de la technologie deepfake. L’échange de visages, au sens propre, ne remplace qu’une partie du visage, ce qui donne une faible idée de ce que les deepfakes peuvent faire.

Pour un échange crédible, vous pourriez également avoir besoin d’imiter le son (mieux connu sous le nom de clonage de voix) et l’ensemble du physique, y compris tout ce qui entre dans le cadre, comme dans cette vidéo de deepfake de Morgan Freeman.

Qu’est-ce qui se passe ici ?

Il se peut que l’auteur du deepfake ait tourné la vidéo lui-même (comme l’indiquent les dernières secondes), qu’il ait synchronisé les dialogues avec la voix synthétique de Morgan Freeman et qu’il ait remplacé la tête de ce dernier.

En conclusion, il ne s’agit pas seulement d’un échange de visages, mais de l’ensemble de l’image, y compris le son.

Vous pouvez trouver des tonnes de deepfakes sur YouTube, à tel point qu’il devient effrayant de savoir à quoi se fier. Et tout ce qu’il faut, c’est un ordinateur puissant doté d’une carte graphique performante pour commencer.

Cependant, la perfection est difficile à atteindre, et c’est particulièrement vrai pour les deepfakes.

Pour créer un deepfake convaincant, capable d’induire le public en erreur ou de l’impressionner, il faut des compétences et quelques jours ou semaines de traitement pour une minute ou deux de vidéo, même si les outils d’échange de visages de l’intelligence artificielle facilitent la tâche.

Il est intéressant de noter que c’est la capacité de ces algorithmes à l’heure actuelle. Mais l’avenir, et notamment l’efficacité de ces applications sur du matériel bas de gamme, a rendu des gouvernements entiers nerveux.

Cependant, nous ne nous pencherons pas sur ses répercussions futures. Au lieu de cela, vérifions comment le faire vous-même pour vous amuser un peu.

Création de vidéos Deepfake (basiques)

Vous pouvez consulter de nombreuses applications disponibles pour créer de fausses vidéos. L’une d’entre elles est Faceswap, que nous allons utiliser.

Nous devons nous assurer de certaines choses avant de commencer. Tout d’abord, nous devons disposer d’une vidéo de bonne qualité de la cible présentant diverses émotions. Ensuite, nous aurons besoin d’une vidéo source à échanger avec la cible.

En outre, fermez toutes les applications gourmandes en ressources graphiques, telles que les navigateurs ou les jeux, avant de procéder à l’échange de visages. Ceci est particulièrement vrai si vous avez moins de 2 gigas de VRAM (RAM vidéo).

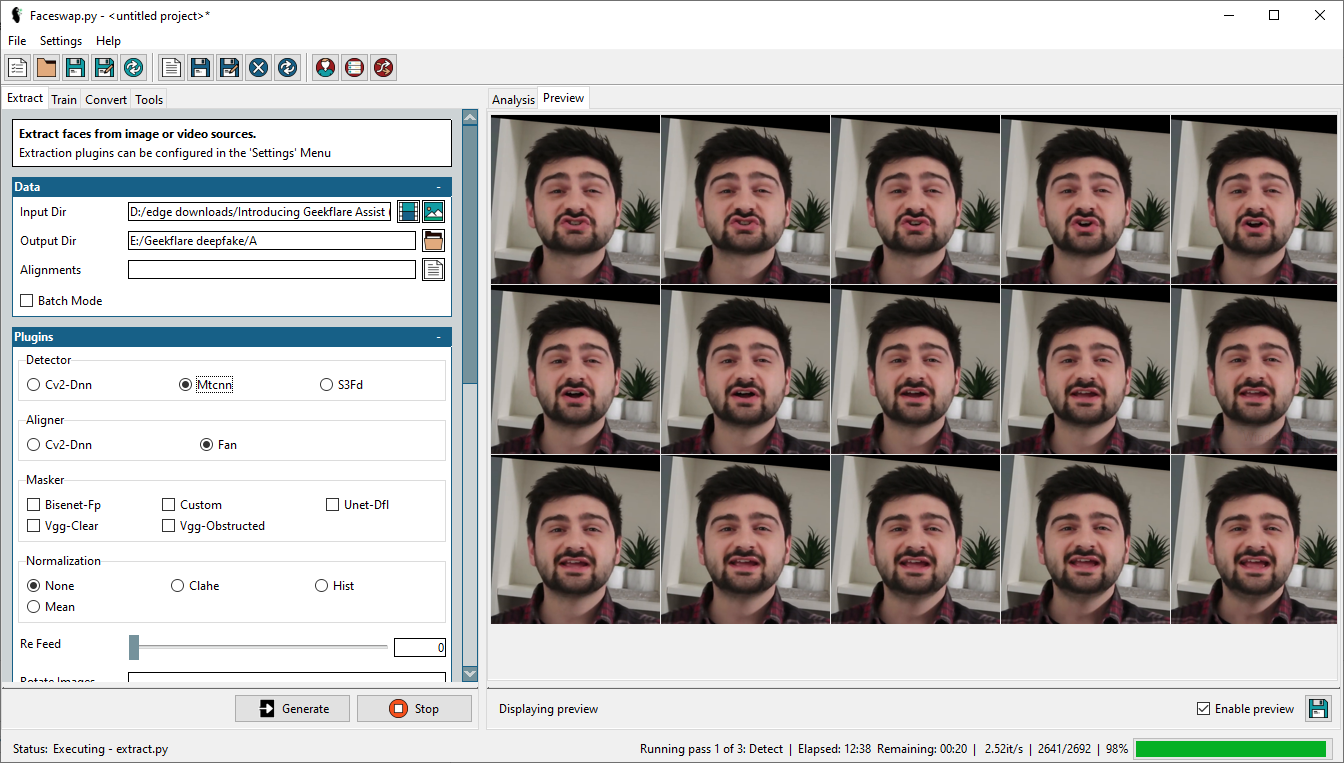

Étape 1 : Extraction des visages

La première étape de ce processus consiste à extraire les visages de la vidéo. Pour cela, nous devons sélectionner la vidéo cible dans le répertoire d’entrée et indiquer un répertoire de sortie pour les extractions.

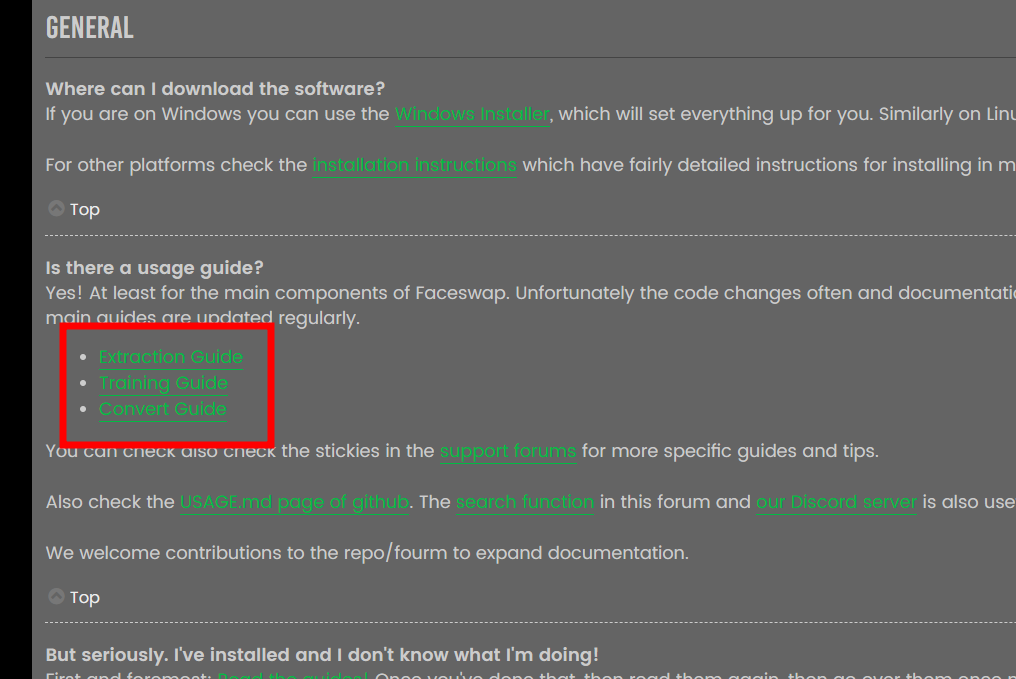

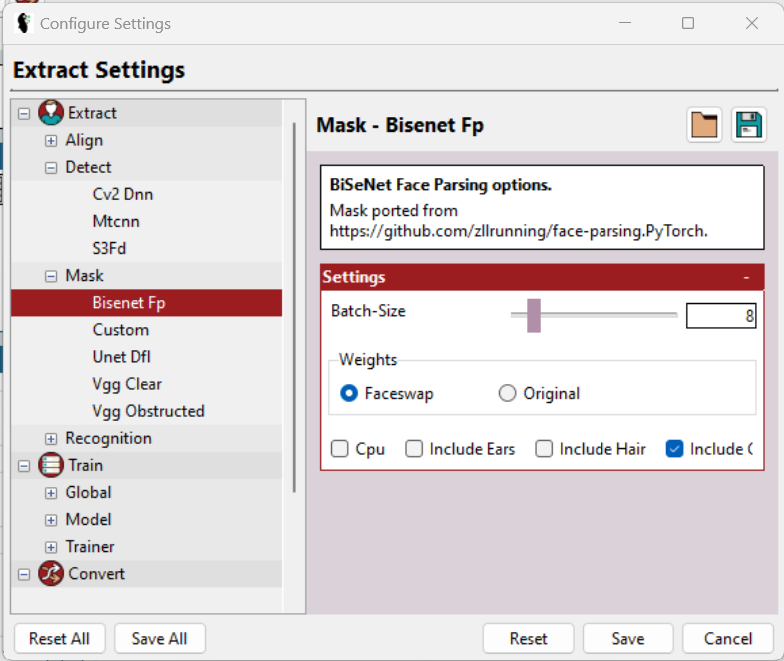

En outre, il y a quelques options, y compris le détecteur, l’aligneur, le masqueur, etc. ; les explications pour chacune d’entre elles sont dans les FAQ de Faceawap, et il serait inutile de répéter l’information ici.

Il est généralement bon de consulter la documentation pour une meilleure compréhension et un résultat décent. Cependant, il y a des textes utiles dans Faceswap que vous pouvez trouver en survolant l’option spécifique.

En résumé, il n’y a pas de méthode universelle, et il faut commencer par les meilleurs algorithmes et descendre progressivement pour créer un deepfake convaincant.

Pour le contexte, j’ai utilisé Mtcnn (détecteur), Fan (aligneur), et Bisenet-Fp (masqueur) tout en gardant toutes les autres options telles quelles.

A l’origine, j’ai essayé avec S3Fd (meilleur détecteur) et quelques autres masques combinés. Cependant, mon Nvidia GeForce GTX 750Ti de 2 Go n’a pas pu supporter la charge, et le processus a échoué à plusieurs reprises.

Finalement, j’ai réduit mes attentes et les paramètres pour aller jusqu’au bout.

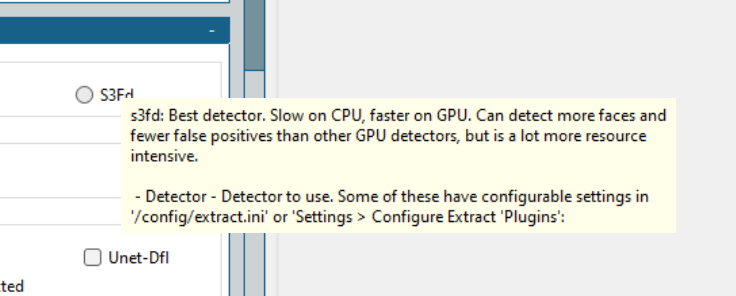

Outre la sélection du détecteur approprié, des masques, etc., il existe quelques options supplémentaires dans Paramètres > Configurer les paramètres qui permettent d’ajuster les paramètres individuels afin d’aider le matériel.

Plus simplement, sélectionnez la taille de lot, la taille d’entrée et la taille de sortie les plus basses possibles, et cochez la case LowMem, etc. Ces options ne sont pas disponibles partout et sont basées sur une section spécifique. De plus, les textes d’aide permettent de sélectionner les meilleures options.

Bien que cet outil fasse un excellent travail d’extraction des visages, les images de sortie peuvent contenir beaucoup plus que ce qui est nécessaire pour entraîner (voir plus loin) le modèle. Par exemple, il y aura tous les visages (si la vidéo en contient plus d’un) et certaines détections incorrectes ne comportant pas du tout le visage cible.

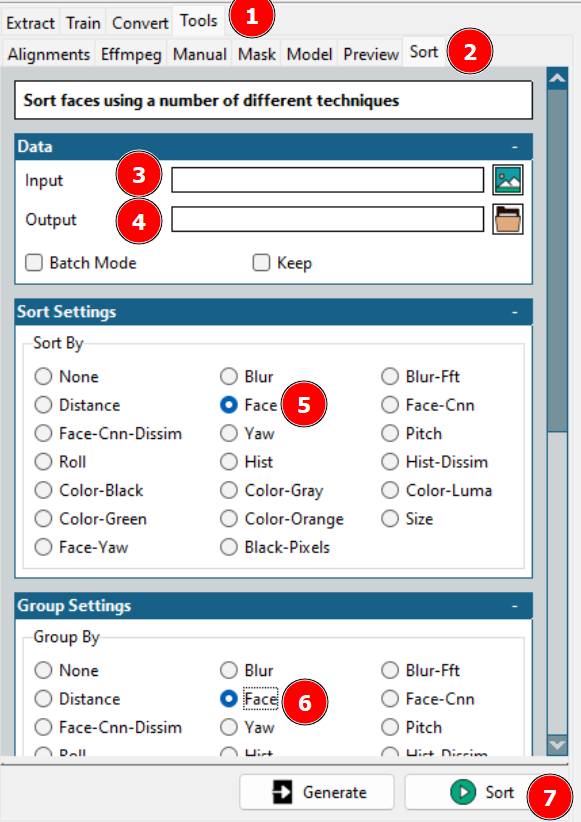

Il faut donc nettoyer les ensembles de données. Vous pouvez soit vérifier le dossier de sortie et le supprimer, soit utiliser le tri Faceswap pour obtenir de l’aide.

L’utilisation de l’outil susmentionné permet de classer les différents visages dans l’ordre, ce qui vous permet de regrouper les visages nécessaires dans un seul dossier et de supprimer le reste.

Pour rappel, vous devrez également répéter l’extraction pour la vidéo d’origine.

Étape 2 : Entraînement du modèle

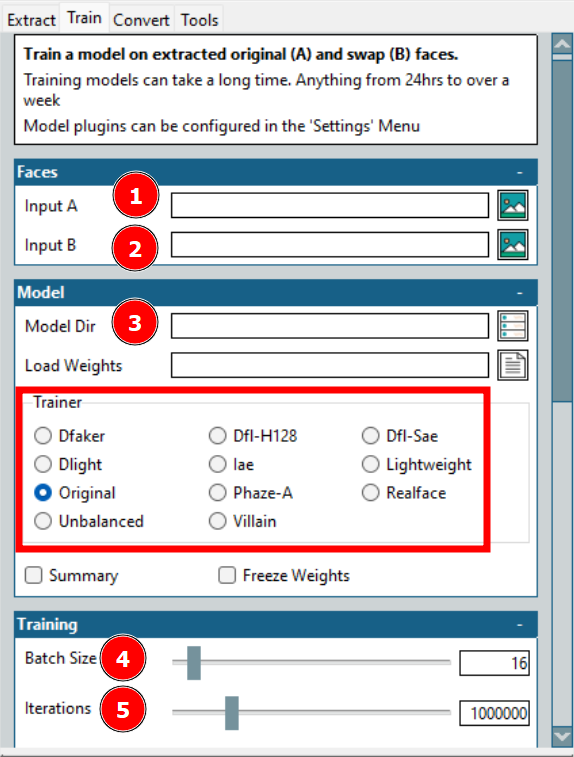

Il s’agit du processus le plus long dans la création d’un deepfake. Ici, l’entrée A se réfère au visage cible, et l’entrée B au visage source. En outre, le répertoire du modèle est l’endroit où les fichiers d’entraînement seront sauvegardés.

Ici, l’option la plus importante est Trainer. Il y en a beaucoup avec des options de mise à l’échelle individuelles ; cependant, ce qui a fonctionné pour mon matériel est Dfl-H128 et Lightweight trainers avec les paramètres de configuration les plus bas.

Vient ensuite la taille du lot. Une taille de lot plus élevée réduit la durée totale de l’entraînement, mais consomme plus de VRAM. Les itérations n’ont pas d’effet fixe sur le résultat, et vous devriez définir une valeur suffisamment élevée et arrêter l’entraînement une fois que les aperçus sont acceptables.

Il existe quelques autres paramètres, notamment la création d’un timelapse avec des intervalles prédéfinis, mais j’ai entraîné le modèle avec le strict minimum.

Étape 3 : Permutation avec l’original

C’est la dernière étape de la création d’un deepfake.

Cela ne prend généralement pas beaucoup de temps et vous pouvez jouer avec de nombreuses options pour obtenir rapidement le résultat souhaité.

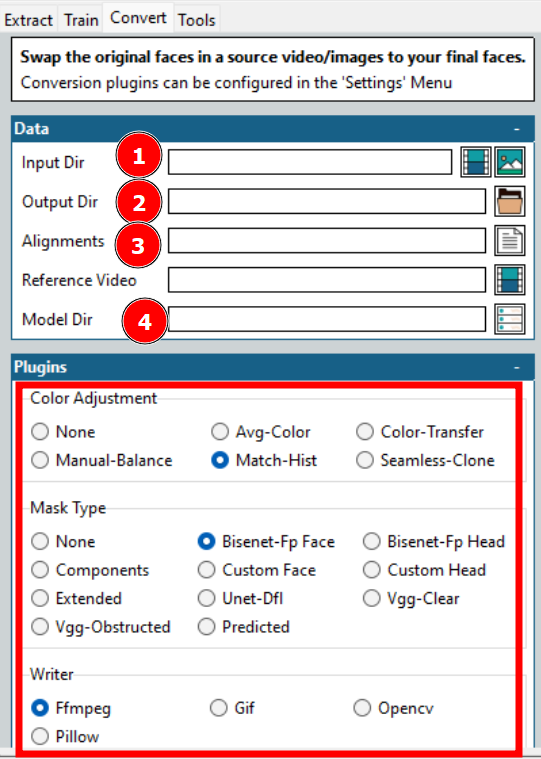

Comme indiqué dans l’image ci-dessus, il y a quelques options à choisir pour commencer la conversion.

La plupart des options ont déjà été discutées, comme les répertoires d’entrée et de sortie, le répertoire du modèle, etc. Une chose cruciale est l’option Alignments qui fait référence au fichier d’alignement (.fsa) de la vidéo cible. Il est créé dans le répertoire d’entrée pendant l’extraction.

Le champ Alignements peut être laissé vide si ce fichier spécifique n’a pas été déplacé. Sinon, vous pouvez sélectionner le fichier et passer à d’autres options. Cependant, n’oubliez pas de nettoyer le fichier d’alignement si vous avez nettoyé les extractions précédemment.

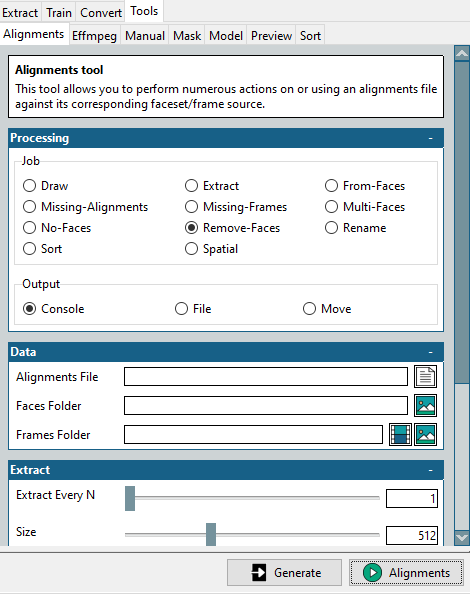

Pour ce faire, ce mini-outil se trouve dans Outils > Alignements.

Commencez par sélectionner Remove-Faces dans la section Job, sélectionnez le fichier d’alignement original et le dossier des faces cibles nettoyées, puis cliquez sur Alignments en bas à droite.

Cela créera un fichier d’alignement modifié, correspondant au dossier des faces optimisées. N’oubliez pas que nous avons besoin de ce fichier pour la vidéo cible, dans laquelle nous voulons effectuer une permutation.

Quelques configurations supplémentaires incluent l’ajustement de la couleur et le type de masque. L’ajustement des couleurs détermine le mélange du masque, et vous pouvez en essayer plusieurs, vérifier l’aperçu et sélectionner l’option optimale.

Le type de masque est plus important. Là encore, cela dépend de vos attentes et du matériel disponible. En règle générale, vous devez également tenir compte des caractéristiques de la vidéo d’entrée. Par exemple, Vgg-Clear fonctionne bien avec des visages frontaux sans obstructions, tandis que Vgg-Obstructed peut également fonctionner avec des obstructions, telles que des gestes de la main, des lunettes, etc.

Ensuite, le Writer vous propose quelques choix en fonction de la sortie que vous souhaitez. Par exemple, sélectionnez Ffmpeg pour un rendu vidéo.

Dans l’ensemble, la clé d’un deepfake réussi est de prévisualiser quelques sorties et d’optimiser en fonction du temps disponible et de la puissance du matériel.

Applications du Deepfake

Il existe de bonnes, de mauvaises et de dangereuses applications des deepfakes.

Les bonnes consistent à recréer des leçons d’histoire par ceux qui étaient réellement présents pour un plus grand engagement.

En outre, les plateformes d’apprentissage en ligne les utilisent pour générer des vidéos à partir de textes.

Mais l’un des plus grands bénéficiaires sera l’industrie cinématographique. Ici, il sera facile d’imaginer le personnage principal en train de faire des cascades, même si c’est le cascadeur qui risque sa vie. En outre, il sera plus facile que jamais de réaliser des films multilingues.

Pour ce qui est des inconvénients, ils sont malheureusement nombreux. La plus grande application de deepfake à ce jour, en fait 96% (selon ce rapport de Deeptrace), est dans l’industrie pornographique pour échanger des visages de célébrités sur des acteurs pornographiques.

En outre, les deepfakes sont également utilisés contre des femmes “normales” qui ne sont pas des célébrités. En général, ces victimes ont des photos ou des vidéos de haute qualité sur leurs profils de médias sociaux qui sont utilisés pour les escroqueries par deepfakes.

Une autre application effrayante est le vishing, ou phishing vocal. Dans l’un de ces cas, le PDG d’une société basée au Royaume-Uni a transféré 243 000 dollars sur ordre du “PDG” de sa société mère allemande, avant de découvrir plus tard qu’il s’agissait en fait d’un faux appel téléphonique.

Mais ce qui est encore plus dangereux, c’est le deepfake qui provoque des guerres ou demande la reddition. Lors d’une tentative récente, le président ukrainien, Volodymyr Zelenskyy, a demandé à ses forces et à son peuple de se rendre dans la guerre en cours. Toutefois, cette fois, la vérité a été trahie par la qualité médiocre de la vidéo.

En conclusion, il existe de nombreuses applications de deepfake, et elles n’en sont qu’à leurs débuts.

Cela nous amène à la question à un million de dollars…

Les “deepfakes” sont-ils légaux ?

Cela dépend en grande partie de l’administration locale. Des lois bien définies, précisant ce qui est autorisé et ce qui ne l’est pas, n’ont pas encore été adoptées.

Ce qui est évident, c’est que tout dépend de l’intention avec laquelle vous utilisez les deepfakes. Il n’y a guère de mal si vous avez l’intention de divertir ou d’éduquer quelqu’un sans perturber la cible de l’échange.

En revanche, les applications malveillantes devraient être punies par la loi, quelle que soit la juridiction. Une autre zone d’ombre est la violation des droits d’auteur, qui doit faire l’objet d’un examen approfondi.

Pour résumer, vous devriez vous renseigner auprès de vos autorités locales sur les applications deepfake légales.

Gardez l’œil ouvert !

Deepfkaes exploite l’intelligence artificielle pour faire dire des choses à n’importe qui.

Ne vous fiez pas à ce que vous voyez sur l’internet est le premier conseil que nous devrions suivre. Il y a des tonnes de fausses informations, et leur efficacité ne fait que croître.